Per decenni abbiamo chiesto ai robot una cosa molto precisa: obbedire. Nel 2026, invece, iniziamo a chiedere qualcosa di piu sottile e piu interessante: capire un'intenzione umana abbastanza bene da trasformarla in azione utile senza costringerci a scrivere ogni singolo passaggio.

Detta cosi sembra fantascienza da conferenza. In realta, tra il framework LLM+ROS raccontato da Metrology News e i demo tecnici pubblicati da Boston Dynamics, il punto e molto piu concreto: il linguaggio naturale sta diventando una nuova interfaccia robotica. Non sostituisce safety, API e tool. Li rende piu accessibili.

Il fatto che cambia il tono della conversazione

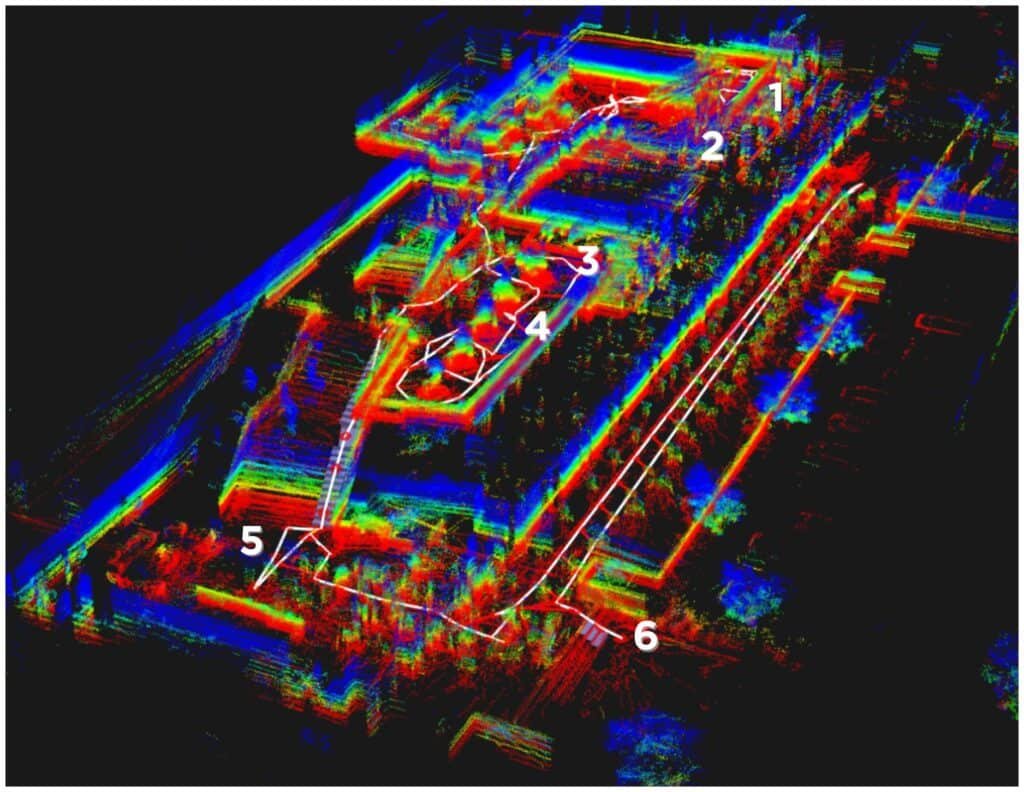

Il segnale forte arriva da due lati diversi ma convergenti. Da un lato, ricercatori di Huawei Noah’s Ark Lab, TU Darmstadt ed ETH Zurich hanno mostrato una struttura in cui un LLM interpreta un comando umano, lo spezza in sotto-task e lo passa a ROS per l'esecuzione. Dall'altro, Boston Dynamics ha raccontato come Spot possa ricevere istruzioni in linguaggio naturale attraverso un layer di tool che traduce le intenzioni in chiamate API concrete.

La differenza rispetto a tante demo del passato sta qui: il robot non viene lasciato libero di improvvisare. Gli si offre un vocabolario di azioni disponibili, confini chiari e ritorni di stato. In altre parole, non stiamo insegnando ai robot a chiacchierare. Stiamo insegnando ai sistemi a collegare intento, contesto e azione senza riscrivere una macchina a stati per ogni scenario.

Ed e qui che il tema esce dal laboratorio. Se un operatore puo dire "controlla quel corridoio", "cerca la perdita", "porta quell'oggetto in quell'area" oppure "verifica se la postazione e libera", il valore non sta nella frase. Sta nel fatto che il sistema sa gia quali sensori interrogare, quali mappe usare, quali azioni puo compiere e quando fermarsi.

La spiegazione, senza fumo negli occhi

Immagina il linguaggio naturale non come un telecomando magico, ma come un caporeparto che traduce obiettivi in istruzioni operative. Da solo non basta. Deve conoscere layout, limiti, strumenti e priorita.

Il framework descritto da Metrology News parla proprio di tre strati:

- comprensione del linguaggio, cioe capire l'intento;

- pianificazione del task, cioe scomporre il lavoro in passi sensati;

- esecuzione via ROS, cioe usare sensori, planner e attuatori per far succedere davvero qualcosa.

Boston Dynamics racconta lo stesso principio da un'altra angolazione. Nel progetto con Gemini Robotics, i prompt in linguaggio naturale vengono tradotti in un set finito di tool: navigare, scattare immagini, identificare oggetti, afferrare, rilasciare. Non e poco. Anzi, e proprio questa limitazione a rendere il sistema utile. Perche in industria il problema non e dire tutto. E dire solo cio che puo essere fatto bene.

Per chi lavora gia su ispezione e sorveglianza robotica o su scenari di asservimento macchine, il punto pratico e questo: il linguaggio naturale non rimpiazza la struttura. La rende piu maneggevole per l'operatore e piu veloce da adattare quando il contesto cambia.

I numeri che fanno alzare un sopracciglio

- 🤖 16,7 miliardi di dollari: valore record del mercato globale delle installazioni di robot industriali secondo l'IFR.

- 📈 5 trend globali per il 2026: e tra questi l'IFR mette proprio AI/autonomia e convergenza IT/OT, cioe il terreno su cui nasce il linguaggio naturale industriale.

- 🧑🏭 40.000 lavoratori manifatturieri da formare: e il target del piano Google.org per le competenze AI nel manufacturing USA, segno che l'interfaccia cambia anche il lavoro umano.

- 🧩 3 layer tecnici ricorrenti: comprensione, pianificazione, esecuzione. Se uno manca, il robot non "capisce": simula soltanto di capire.

E quindi, cosa cambia per noi?

Cambia che il collo di bottiglia non e piu solo la programmazione tradizionale. Diventa la qualita del perimetro in cui lasci lavorare il modello. Se gli dai mappe deboli, tool confusi, priorita vaghe o regole di safety approssimative, il linguaggio naturale non semplifica niente. Sposta solo il caos da una schermata all'altra.

Al contrario, quando il contesto e ben preparato, il vantaggio e reale. Un robot puo diventare piu rapido da istruire, piu adattabile a micro-variazioni e piu facile da usare da parte di team non composti solo da specialisti software. Ed e qui che questa evoluzione tocca anche chi guarda a robot di campo come Unitree B2 o a soluzioni che devono raccogliere dati e reagire in ambienti non perfetti.

La vera novita, quindi, non e sentire un robot "parlare". La vera novita e vedere il lavoro di programmazione diventare sempre di piu un lavoro di orchestrazione di limiti, strumenti e feedback. Meno script monolitici. Piu sistemi che sanno interpretare un obiettivo restando dentro un recinto sicuro.

Conclusione

Il 2026 non ci sta portando verso robot che capiscono tutto. Ci sta portando verso robot che, dentro un perimetro ben progettato, possono capire abbastanza da farci lavorare meglio e piu in fretta.

E una differenza meno spettacolare di quanto promettono certi titoli, ma molto piu utile. Se vuoi capire dove il linguaggio naturale puo diventare davvero un vantaggio operativo nella tua realta, parliamone: la buona interfaccia, in robotica, comincia sempre dai limiti giusti.

Articoli correlati

Vedi tutti →

IntBot e Certis: i robot sociali devono superare il test del pubblico

Sensori e visione GMSL: perché il robot industriale vede solo se la rete regge

XELA al Robotics Summit: il tatto diventa un dato industriale

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.