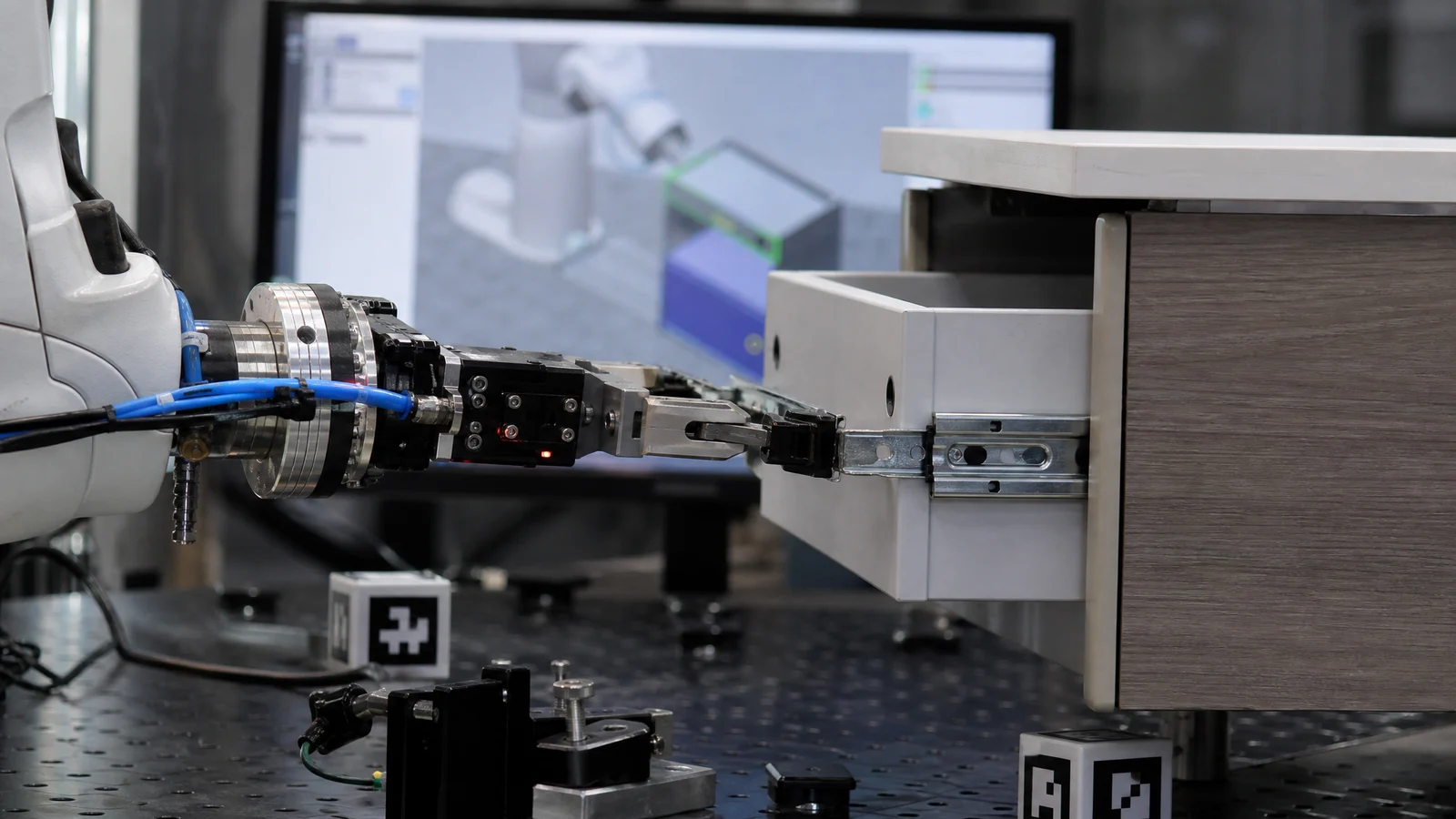

C'è un modo molto concreto per capire perché la robotica è più difficile del software: un robot non deve solo riconoscere un cassetto, deve tirarlo senza romperlo. Deve capire dove sta la maniglia, come scorre il giunto, quanto può aprirlo, cosa succede se l'oggetto è più duro, più largo o meno allineato del previsto.

Il preprint Articraft, pubblicato su arXiv il 14 maggio 2026, parte da questa carenza: mancano dataset grandi e diversi di oggetti 3D articolati. Gli autori propongono un sistema agentico che usa LLM per scrivere programmi capaci di costruire asset 3D con parti, geometrie, giunti e test di validazione. Il risultato dichiarato è Articraft-10K, una collezione curata di oltre 10.000 asset articolati in 245 categorie, pensata per training, simulazione robotica e realtà virtuale.

In sintesi

Articraft-10K conta perché ricorda che un robot non impara solo da immagini, ma da oggetti con parti mobili, attriti, vincoli e failure mode. Per un pilot industriale la domanda utile non è quanti asset esistono nel dataset, ma quanto assomigliano ai pezzi, alle fixture e agli errori che la cella dovrà gestire.

Perché un cassetto sintetico può contare

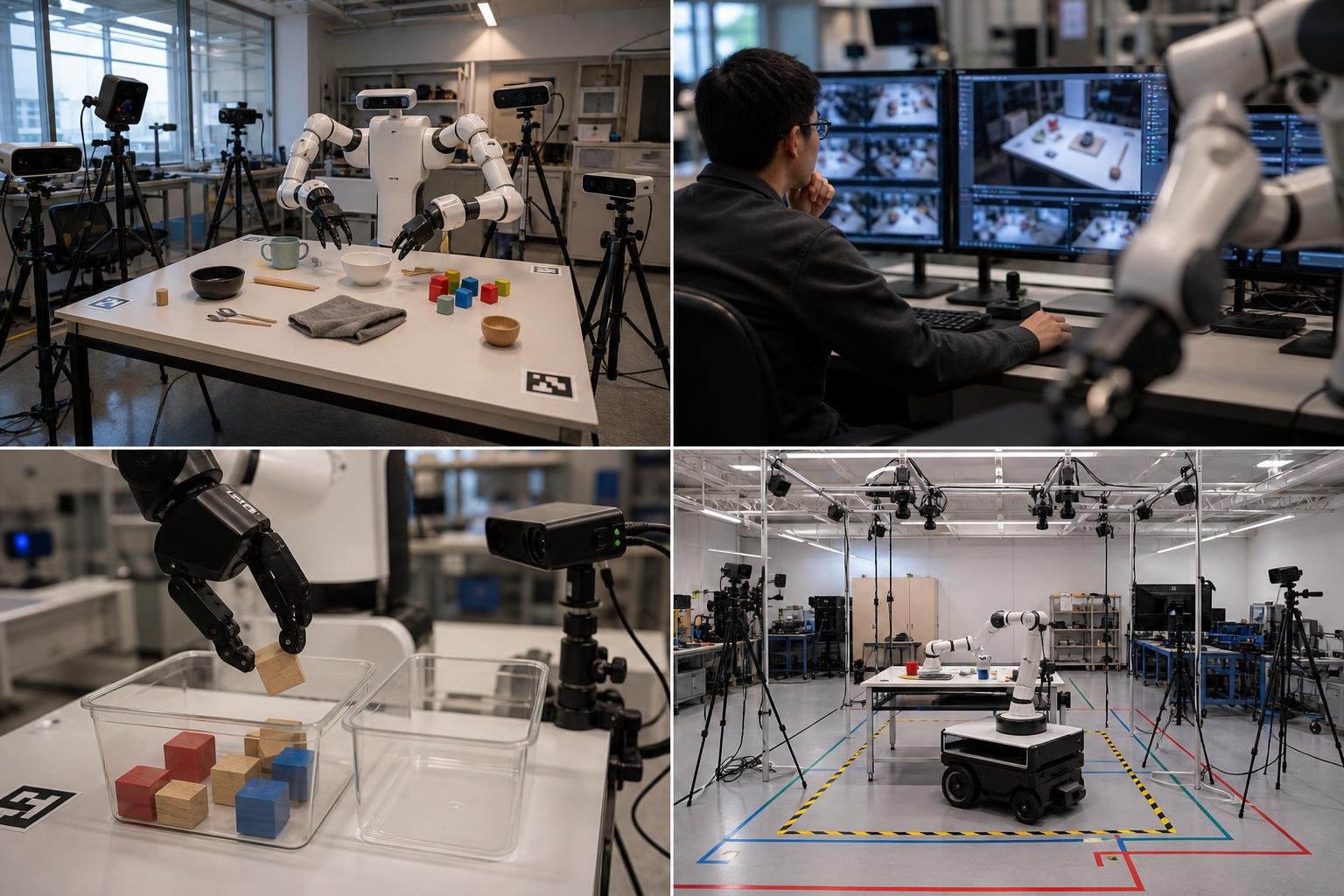

A prima vista sembra materiale da laboratorio grafico. In realtà è uno dei colli di bottiglia della physical AI. Se vogliamo robot più flessibili nella movimentazione interna, nell'asservimento o nella manipolazione di oggetti variabili, dobbiamo esporli a più casi di quanti se ne possano raccogliere comodamente in fabbrica.

La simulazione serve proprio a questo: moltiplicare casi, variazioni e fallimenti prima di arrivare alla cella reale. Ma un oggetto 3D “bello” non basta. Per il robot, la differenza tra un cubo e una porta è il vincolo: una ruota gira, una cerniera ruota su un asse, un cassetto trasla, una valvola oppone resistenza. Senza questi dettagli, il modello impara l'immagine dell'oggetto, non il suo comportamento.

L'idea furba: far scrivere oggetti come programmi

Articraft riduce la generazione di un asset articolato a un problema di programmazione. L'LLM non “disegna” liberamente: scrive codice dentro un'interfaccia dedicata, definisce componenti, compone geometrie, specifica giunti e passa attraverso un harness che valida l'asset con feedback strutturato. È un dettaglio importante perché riduce l'effetto demo: un oggetto può sembrare plausibile a schermo e restare inutile se il suo giunto non ha senso.

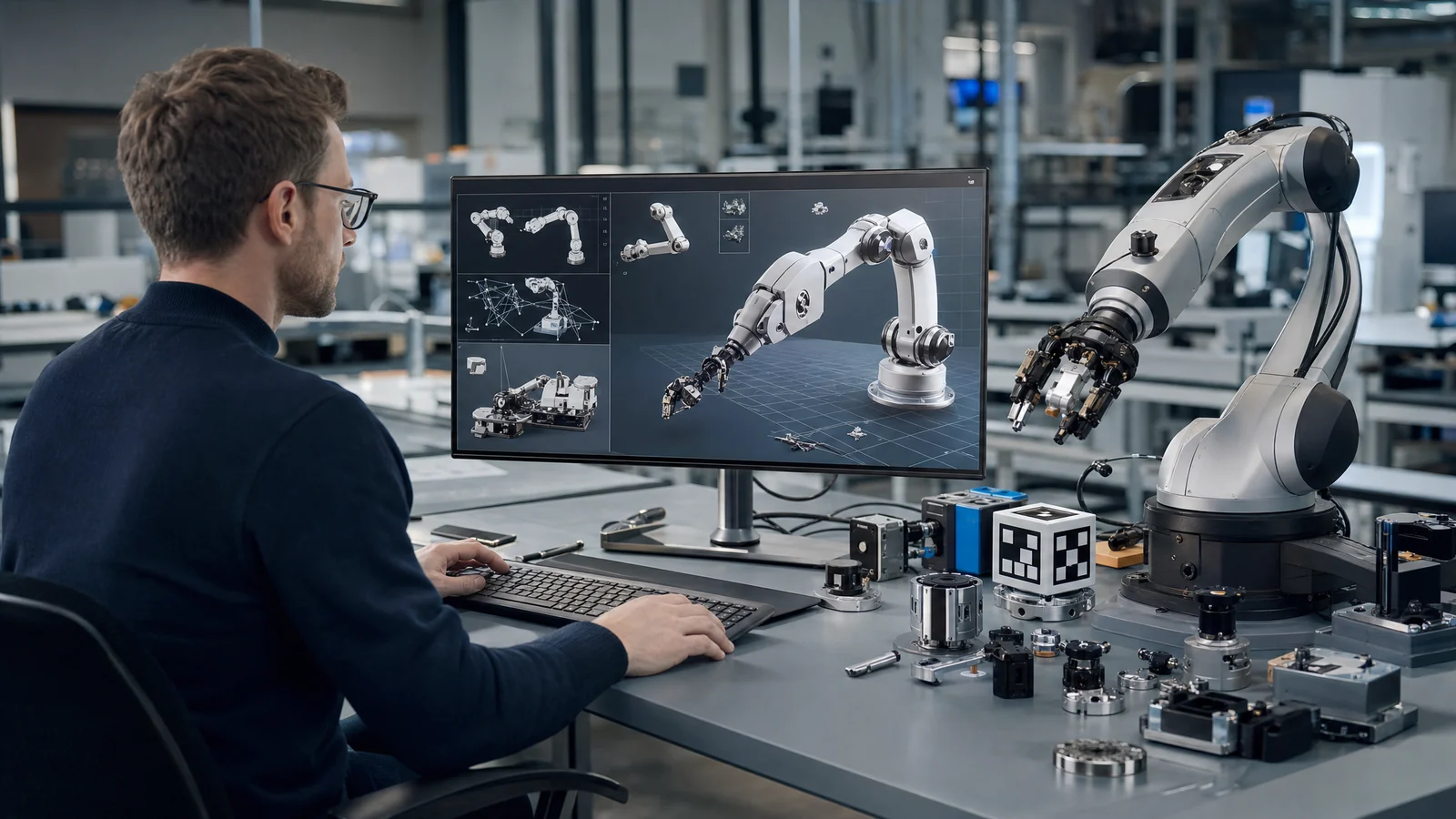

Per chi integra robot, questa logica è familiare. Un progetto serio non vive di immagini persuasive, ma di vincoli: corsa utile, ingombri, tolleranze, punti di presa, sicurezza, recovery. La parte interessante è che questi vincoli iniziano a entrare anche nel modo in cui generiamo i dati per addestrare i modelli.

Dalla simulazione alla cella: il ponte resta duro

Qui serve prudenza. Un dataset di asset sintetici non elimina il sim-to-real gap. Materiali, attriti, riflessi, giochi meccanici, vibrazioni e usura non spariscono perché il simulatore contiene 10.000 oggetti. Però un dataset migliore cambia il punto di partenza. Un robot che ha visto molti tipi di cerniere, leve, manopole e contenitori può arrivare al test fisico con ipotesi più ricche.

Per applicazioni Bubbles, il tema è concreto quando si parla di bracci robotici chiamati a manipolare componenti non perfettamente identici o di AMR che devono interagire con carrelli, sportelli, cassette e stazioni di prelievo. Non basta dire “AI”: bisogna costruire una libreria di casi reali e sintetici che rappresentino davvero il lavoro.

Cosa dovrebbe chiedere una PMI

Quando un fornitore parla di robot learning, conviene portare la conversazione sui dati:

- quali oggetti simili ai nostri sono presenti nel training o nel simulatore?

- i giunti sono modellati o sono solo mesh decorative?

- le variazioni coprono tolleranze, orientamenti, errori di posizionamento e usura?

- i test includono fallimenti, non solo traiettorie riuscite?

- quali casi devono essere raccolti in stabilimento prima del pilot?

- il dataset resta nostro, del fornitore o misto?

Queste domande sembrano meno affascinanti di un video virale. Sono però quelle che separano una prova utile da una demo che non scala.

Conclusione

Articraft-10K è interessante perché sposta l'attenzione dal robot “intelligente” all'ambiente che lo allena. La physical AI non avanza solo con modelli più grandi, ma con oggetti migliori, vincoli più realistici e test più severi.

Per chi produce, il messaggio è pratico: prima di chiedere al robot di generalizzare, chiediamoci se gli abbiamo mostrato abbastanza mondo reale. Se vuoi valutare un task dove simulazione e test fisico possono ridurre il rischio di un pilot, parliamone con un caso concreto: oggetto, presa, errore ammesso e ciclo da rispettare.

Fonti consultate

Articoli correlati

Vedi tutti →

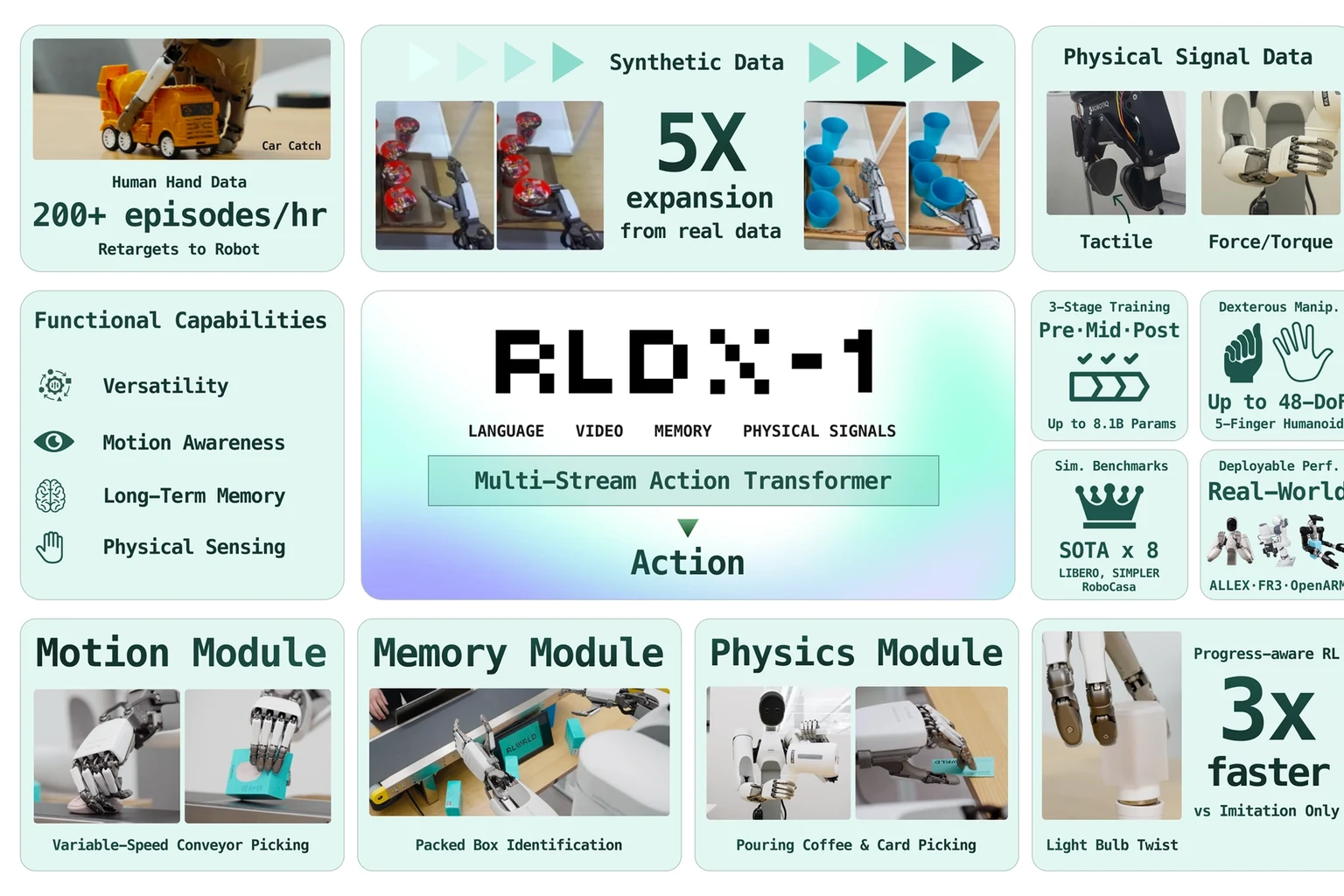

RLDX-1: la mano robotica che impara a sentire

Robot che imparano guardando video: promessa o scorciatoia?

Pelican-Unified: il robot che immagina prima di agire

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.