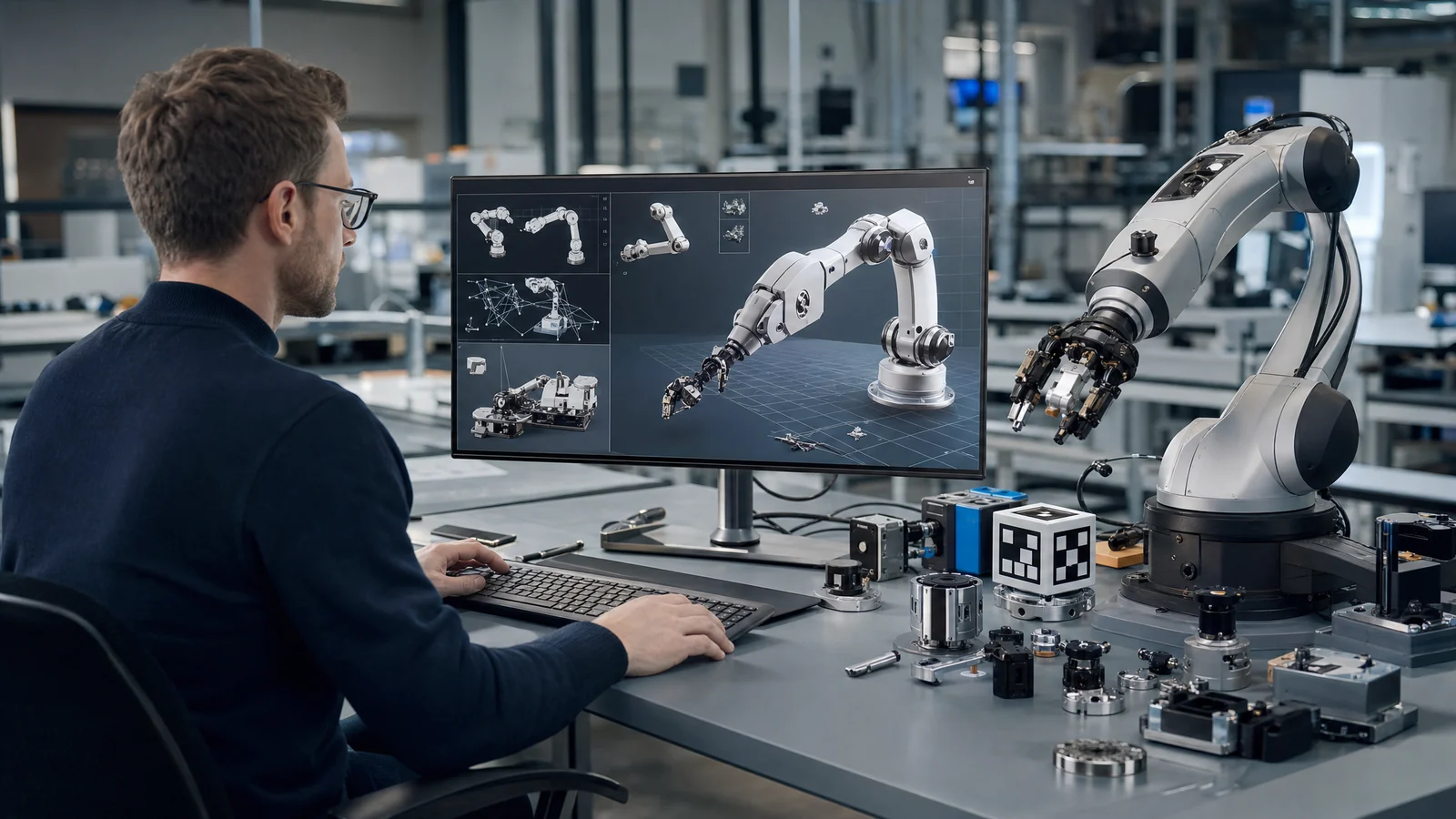

Un robot industriale affidabile non deve soltanto riconoscere un oggetto. Deve capire il contesto, scegliere un'azione, prevedere cosa succede dopo e correggere se la realtà non segue il piano. È il motivo per cui la physical AI sta provando a unire capacità che per anni sono rimaste separate: visione, linguaggio, pianificazione, simulazione e controllo.

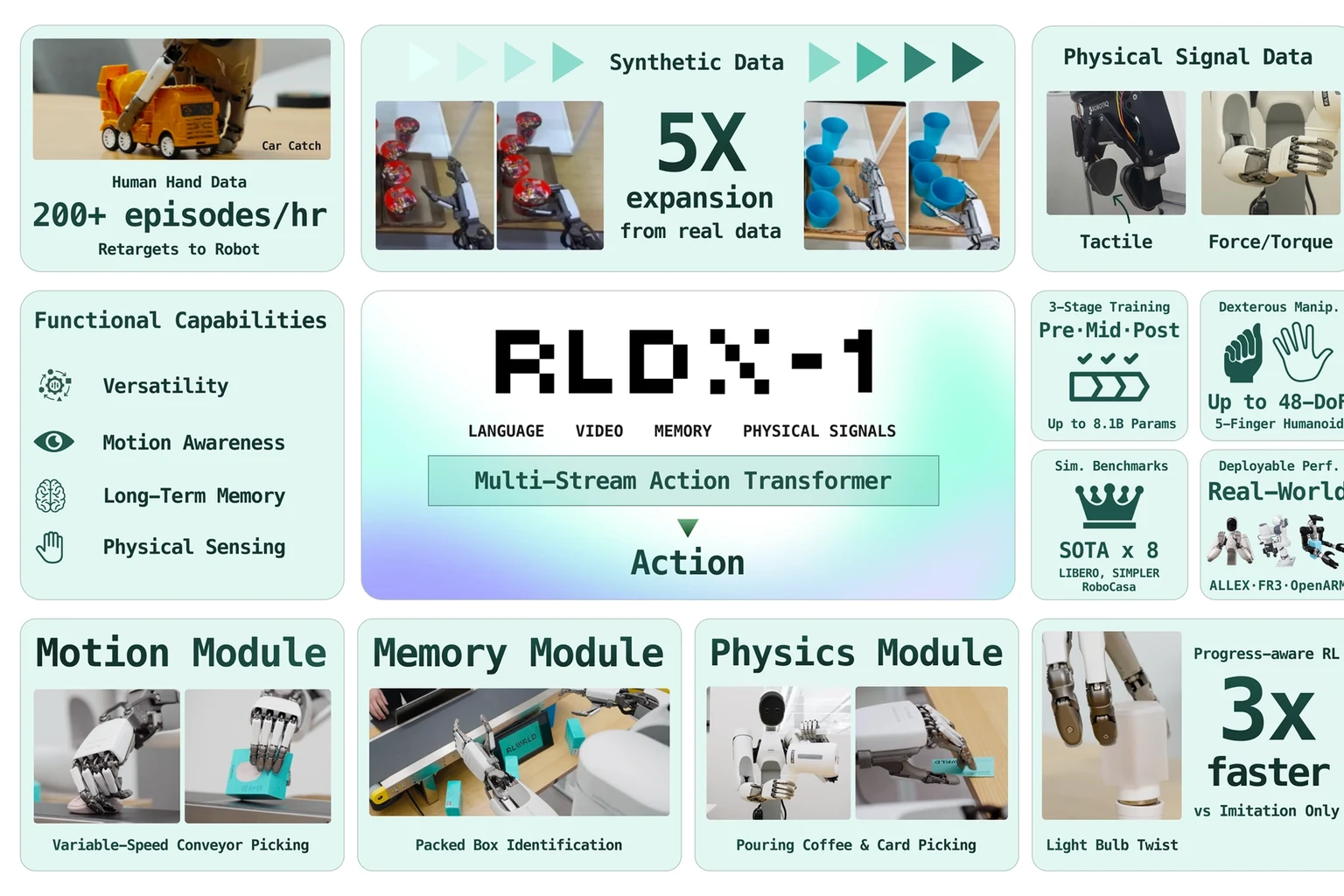

Il preprint Pelican-Unified 1.0, pubblicato su arXiv il 14 maggio 2026, entra in questa direzione. Gli autori lo presentano come un embodied foundation model addestrato secondo un principio di unificazione: un unico VLM mappa scene, istruzioni, contesti visuali e storia delle azioni in uno spazio condiviso; lo stesso modulo produce catene di ragionamento orientate al task; un generatore di futuro produce video e azioni future. Nel paper, un singolo checkpoint raggiunge 64,7 su otto benchmark VLM, 66,03 su WorldArena e 93,5 su RoboTwin, secondo migliore valore medio tra i metodi d'azione confrontati.

In sintesi

Pelican-Unified è rilevante per la robotica industriale perché sposta l'attenzione dal singolo modulo AI alla catena completa scena-istruzione-previsione-azione. Per una PMI non è una tecnologia da comprare a scatola chiusa: è un criterio per chiedere tracciabilità, fallback e test sul task reale prima di fidarsi di una cella embodied AI.

Perché oggi conta

La notizia non è “un altro modello AI per robot”. La notizia è il tentativo di ridurre la frammentazione. Molti sistemi robotici oggi sembrano una catena di moduli: uno vede, uno interpreta, uno pianifica, uno controlla, uno registra. Funziona, ma ogni passaggio può perdere informazione. Pelican-Unified prova a far viaggiare scene, istruzioni, memoria dell'azione e previsione dentro un'unica rappresentazione.

Per una fabbrica, questo è interessante solo se porta benefici verificabili: meno errori di interpretazione, recovery più rapide, traiettorie più robuste, test più chiari. In una cella di controllo qualità e ispezione o in un flusso di scarico e carico, la domanda resta sempre la stessa: il modello migliora il processo o aggiunge opacità?

Immaginare non significa essere sicuri

La parte più suggestiva è il “future generator”: il modello non produce solo una risposta, ma condiziona video futuri e azioni. È un'idea potente perché molti errori robotici nascono da conseguenze non previste: il pezzo scivola, il gripper copre la camera, un oggetto vicino viene urtato, la traiettoria crea un ingombro.

Ma immaginare non significa sapere. Una previsione video può aiutare il robot a pianificare, però in ambiente industriale deve restare collegata a sensori, limiti di sicurezza e logiche deterministiche. Se un cobot lavora vicino a un operatore o se un AMR attraversa un'area mista, il modello può suggerire; la safety deve decidere con regole certificate e segnali affidabili.

Il valore sta nei confini

Pelican-Unified è un segnale di ricerca, non una soluzione pronta da installare domani mattina. Però indica un requisito che arriverà nei capitolati: non vogliamo modelli brillanti ma isolati, vogliamo sistemi che spieghino cosa hanno visto, quale azione prevedono e quale fallback attivano.

Per valutare un modello embodied in fabbrica servono almeno quattro prove:

- test su oggetti e layout simili al caso reale;

- confronto tra azione prevista e azione eseguita;

- misura dei fallimenti recuperati, non solo dei successi;

- tracciabilità di ragionamento, immagini, comandi e limiti safety.

Senza questa disciplina, l'unificazione rischia di diventare una scatola nera più grande. Con questa disciplina, può diventare una base più coerente per celle adattive.

Cosa cambia per chi compra robot

Nel breve periodo, non cambia la regola di base: partire dal processo. Nessun modello sostituisce la mappatura di ciclo, variabilità, difetti, safety, operatori e integrazione con PLC o MES. Cambia però la conversazione con i fornitori. Quando propongono embodied AI, bisogna chiedere come il sistema collega percezione e azione, come prevede i casi critici e come documenta una decisione sbagliata.

Per Bubbles, il punto è usare questa ricerca come lente, non come slogan. Un robot più capace deve restare comprensibile al plant manager. Se la cella non spiega perché si ferma, perché chiede conferma o perché cambia traiettoria, l'AI non riduce il rischio: lo sposta.

Conclusione

Pelican-Unified 1.0 racconta bene dove si muove la robotica: modelli che non vogliono più essere solo occhi, cervello o controller, ma una catena unica tra scena e azione. È una direzione promettente, soprattutto per task variabili e ambienti meno strutturati.

La fabbrica, però, continuerà a fare la domanda più sobria: cosa succede quando il modello sbaglia? Se la risposta include sensori, limiti, log, fallback e responsabilità chiare, allora l'embodied AI può entrare nel progetto. Se vuoi capire dove questa logica può aiutare una cella reale, iniziamo dal task, non dal benchmark.

Fonti consultate

Articoli correlati

Vedi tutti →Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.