Un bambino impara moltissimo guardando. Un robot, finora, molto meno. Per insegnargli un compito servono dimostrazioni, sensori, traiettorie, correzioni, ambienti controllati e parecchia pazienza. Per questo la nuova idea che circola nella robotica è così potente: e se i robot potessero imparare anche dai video?

The Robot Report ha rilanciato il tema parlando con Eric Chan di Rhoda AI. La tesi è netta: la raccolta tradizionale di dati robotici non scala abbastanza. I video, invece, sono ovunque e contengono una quantità enorme di conoscenza fisica: mani che afferrano, oggetti che cadono, liquidi che scorrono, porte che si aprono, superfici che resistono.

In sintesi

I video possono accelerare l'apprendimento robotico solo se diventano dati verificabili: previsione visuale, azione, errore e recovery devono essere misurati nello stesso flusso. Per questo il tema si collega ai data robotici in fabbrica e ai pilot su assemblaggio o asservimento macchine, dove il valore non è la demo ma la ripetibilità del task.

Il trucco non è copiare il video

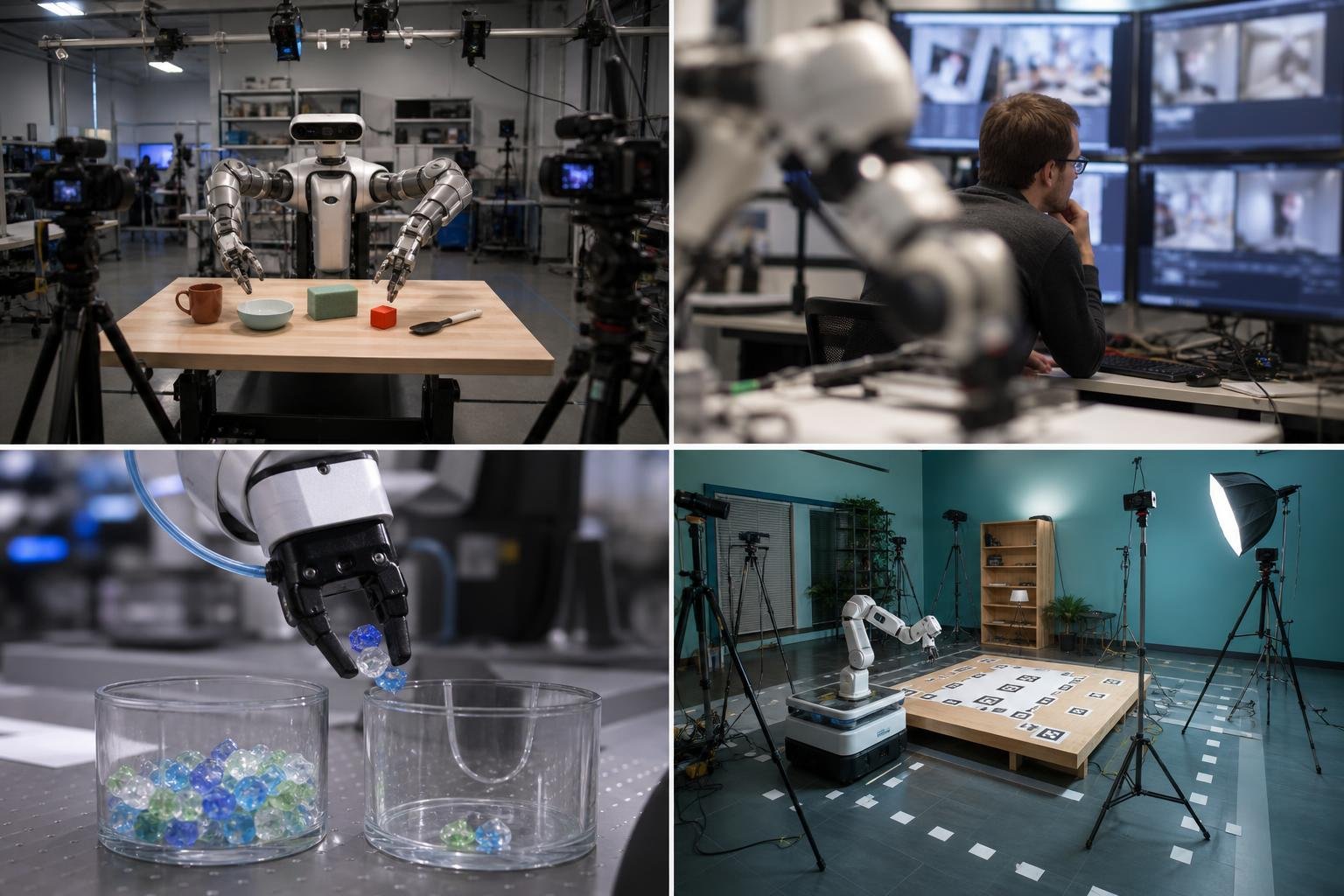

Dire “il robot impara dai video” può far pensare a una scorciatoia quasi magica: guardo una persona versare acqua, poi il robot lo fa. Non è così semplice. Il punto dei Direct Video-Action Models di Rhoda AI è diverso: il modello prova a prevedere i frame futuri e poi un modulo traduce quella previsione in azioni robotiche.

In pratica il robot non riceve solo un comando astratto. Costruisce una piccola ipotesi visuale su come dovrebbe evolvere la scena: il contenitore si inclina, il liquido si sposta, il gripper mantiene presa, l'oggetto cambia posizione. Poi il sistema prova a trasformare quella previsione in movimento.

Questa differenza conta perché rende il comportamento più ispezionabile. Se il modello genera una previsione video, un tecnico può vedere che cosa “si aspetta” prima che l'azione venga eseguita. Non risolve automaticamente la safety, ma offre un appiglio in più rispetto a una decisione completamente opaca.

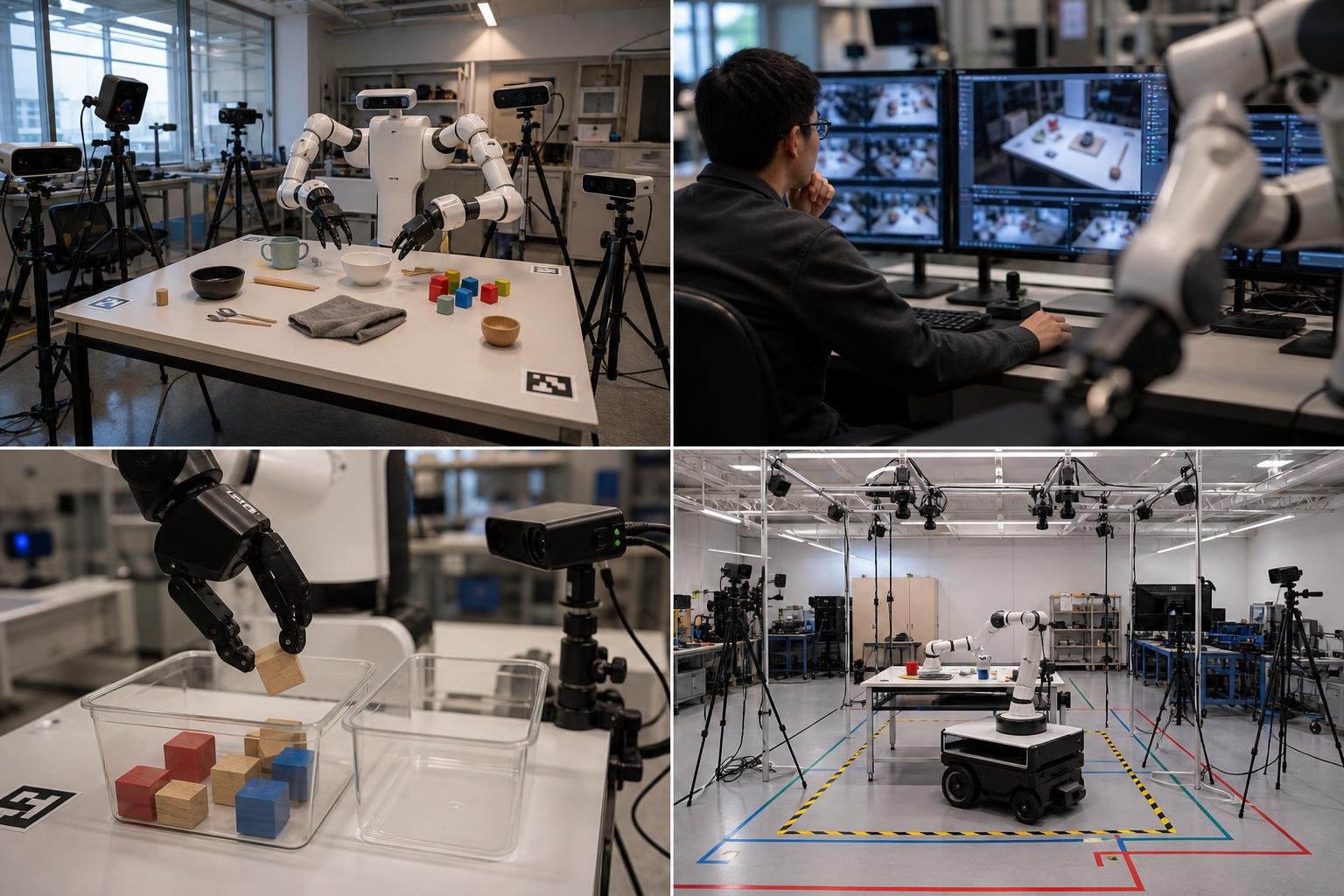

Perché i dati robotici sono così difficili

I modelli linguistici hanno imparato da testi pubblici in scala enorme. I robot non hanno lo stesso lusso. Ogni dato robotico richiede hardware, spazio, tempo, usura, supervisione e spesso un ambiente specifico. Raccogliere migliaia di ore di manipolazione con un robot fisico è costoso; raccoglierne abbastanza da coprire tutti i casi limite è ancora più difficile.

Rhoda AI sostiene che i video web siano una fonte molto più ampia per imparare dinamiche del mondo. Nella sua pagina tecnica cita vantaggi come apprendimento data-efficient, memoria visuale lunga e one-shot learning da una singola dimostrazione. Sono promesse forti e vanno verificate su casi reali, ma indicano una direzione: il robot del futuro potrebbe arrivare in fabbrica già con un'intuizione fisica pre-addestrata, da adattare poi al processo specifico.

Per il lettore non tecnico, l'analogia migliore è questa: non stiamo insegnando al robot una ricetta a memoria, stiamo cercando di dargli un'aspettativa su come si comportano gli oggetti. È la differenza tra seguire una lista di istruzioni e capire quando qualcosa sta andando storto.

Dove può servire davvero

I casi più interessanti non sono quelli perfetti da video demo. Sono quelli pieni di piccola variabilità: prendere oggetti non sempre nella stessa posizione, alimentare una macchina con pezzi orientati male, spostare materiale deformabile, gestire packaging diverso, osservare un operatore e trasformare una dimostrazione in un task ripetibile.

Qui entrano in gioco anche soluzioni più vicine al presente. Un cobot per assemblaggio o un sistema di asservimento macchine può già generare video, log e cicli utili. Un Dobot CR10 non diventa generalista da solo, ma può essere parte di un percorso in cui i dati della cella rendono il task più facile da replicare e migliorare, soprattutto se la raccolta dati viene pensata prima come mappa di KPI industriali e solo dopo come modello AI.

Il limite: il mondo non perdona

Un video può insegnare molto, ma non sente la coppia sul giunto, non misura la temperatura del motore, non conosce sempre il coefficiente di attrito e non garantisce che l'oggetto reale sia uguale a quello visto online. La robotica resta fisica: se una presa fallisce, il pezzo cade; se una traiettoria sbaglia, la macchina si ferma; se un modello generalizza male, qualcuno deve recuperare.

Per questo la domanda giusta non è “i robot impareranno dai video?”. Probabilmente sì, almeno in parte. La domanda industriale è: con quali limiti, con quali test, con quale fallback e con quale responsabilità quando la previsione visuale è sbagliata?

Conclusione

I robot che imparano guardando video non sono fantascienza, ma non sono neanche una scorciatoia per saltare integrazione, safety e processo. Sono un nuovo ingrediente nella lunga catena che porta dalla demo al reparto.

La parte eccitante è che l'addestramento potrebbe diventare meno artigianale. La parte sobria è che ogni fabbrica dovrà comunque misurare il proprio task, i propri dati e i propri errori. È lì che la robotica smette di guardare video e comincia a lavorare.

Fonti consultate

Articoli correlati

Vedi tutti →

Figure 03: un umanoide ogni ora, ma la notizia è BotQ

1X avvia la fabbrica NEO: gli umanoidi entrano in produzione

Il robot che cucina a due mani: perché GENE-26.5 conta

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.