La cosa difficile, per un robot, non è afferrare un cubo in una demo ordinata. È versare, ruotare, correggere una presa, sentire quando un oggetto cambia peso, capire che il contatto è avvenuto davvero e non solo che la telecamera vede qualcosa vicino alla mano.

È per questo che RLDX-1, presentato da RLWRLD il 7 maggio 2026 e pubblicato anche come technical report su arXiv, merita attenzione. Non perché risolva di colpo la destrezza robotica, ma perché dice una cosa semplice: i modelli Vision-Language-Action generalisti non bastano se il problema vive nel contatto fisico.

In sintesi

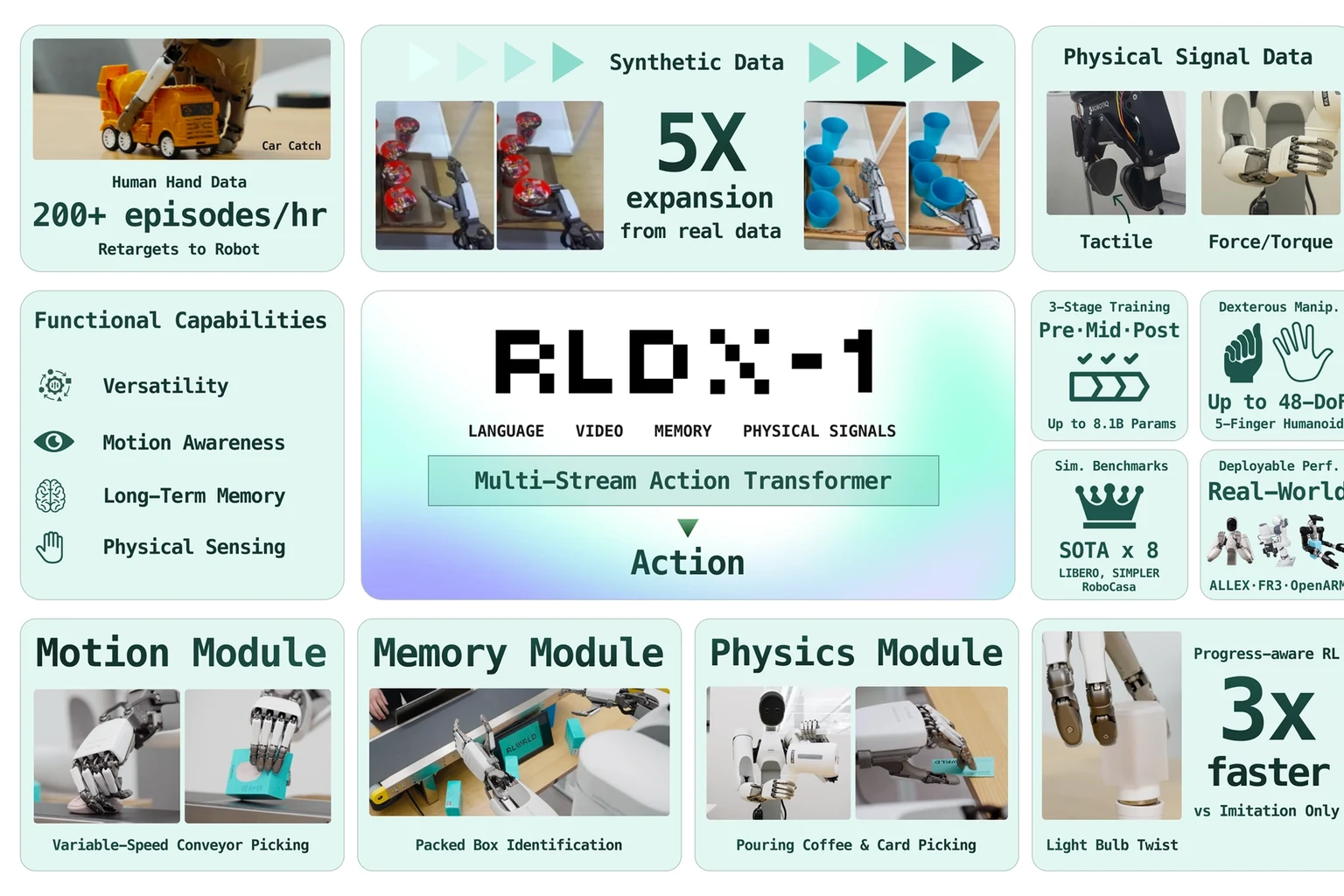

RLDX-1 è un foundation model per manipolazione destra che integra visione, movimento, memoria e segnali fisici come torque e tatto. L'idea è superare la logica “vedo e agisco” con una policy che possa ricordare cosa è successo, percepire il contatto e adattarsi a compiti più lunghi o più instabili.

Perché le mani robotiche sono così ostinate

Una pinza parallela è brutale ma chiara: apre, chiude, prende. Una mano a cinque dita promette molto di più, ma introduce un problema enorme: molti gradi di libertà, contatti distribuiti, oggetti che scivolano, pesi che cambiano, micro-correzioni continue.

RLDX-1 parte proprio da questa frizione. Nel blog tecnico, RLWRLD scrive che i migliori VLA disponibili falliscono su task come versare, ruotare in mano o afferrare in modo reattivo non per mancanza di “intelligenza” generale, ma perché non ricevono le modalità giuste: geometria mano-oggetto, forze di contatto e dinamiche temporali.

Questa è una lettura importante anche per l'industria. Non basta collegare una telecamera a un robot e aspettarsi che il modello capisca il mondo fisico. Se il task dipende da peso, attrito, contatto e sequenza, quei segnali devono entrare nel progetto.

Cosa aggiunge RLDX-1 rispetto ai VLA generici

Il technical report descrive RLDX-1 come una policy robotica basata su Multi-Stream Action Transformer, cioè un'architettura che dà stream dedicati a modalità diverse e poi le fonde con attenzione congiunta. Tradotto: invece di buttare visione, linguaggio, torque, memoria e movimento nello stesso contenitore sperando che il modello faccia ordine, ogni segnale mantiene una sua strada prima della decisione finale.

I componenti chiave sono quattro:

- un VLM specializzato su dati robotici, per ragionare meglio su relazione tra end-effector e oggetto;

- un Motion Module, per non decidere solo sul singolo frame ma sulla dinamica della scena;

- un Physics Module, per includere torque e tatto come segnali nativi;

- una Memory Module, per ricordare lo stato del compito e non trattare ogni azione come episodio isolato.

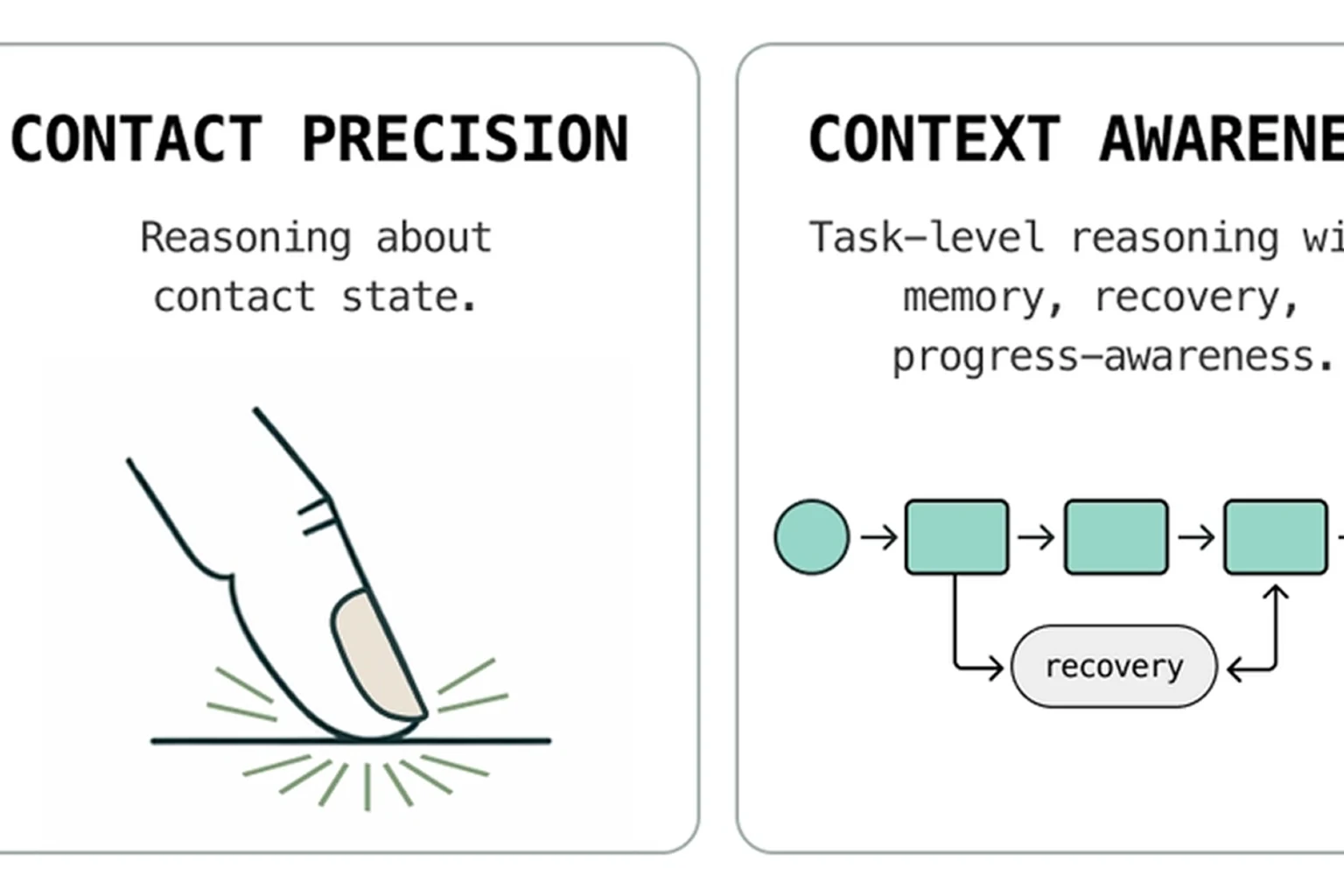

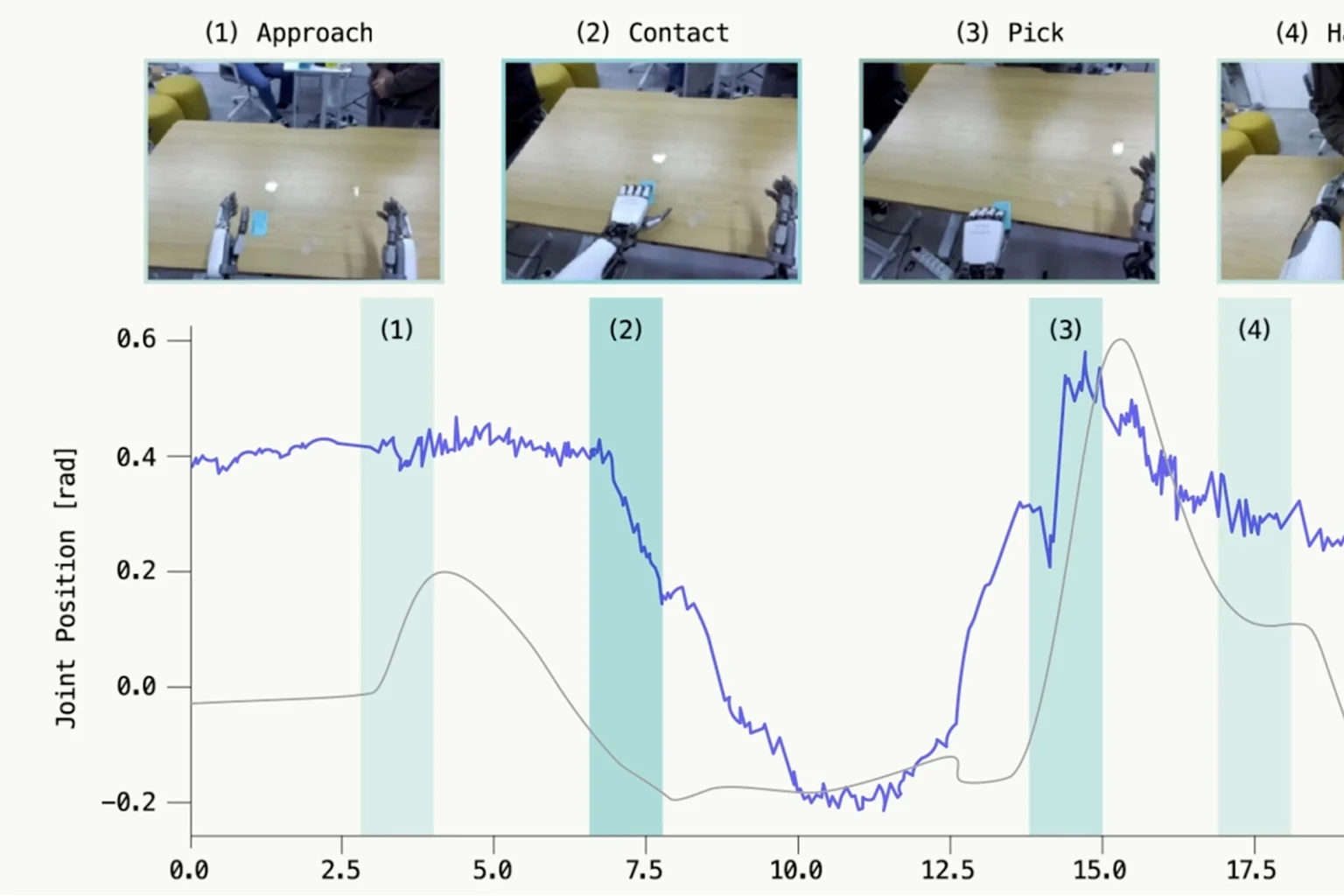

Il punto più concreto è il modulo fisico. Se una caraffa si alleggerisce mentre versi, la telecamera può vedere quasi la stessa scena. Il segnale utile sta nel peso e nel momento. Se una presa sta per perdere attrito, il video può arrivare tardi. Il contatto, invece, parla prima.

Il dato spettacolare va letto con prudenza

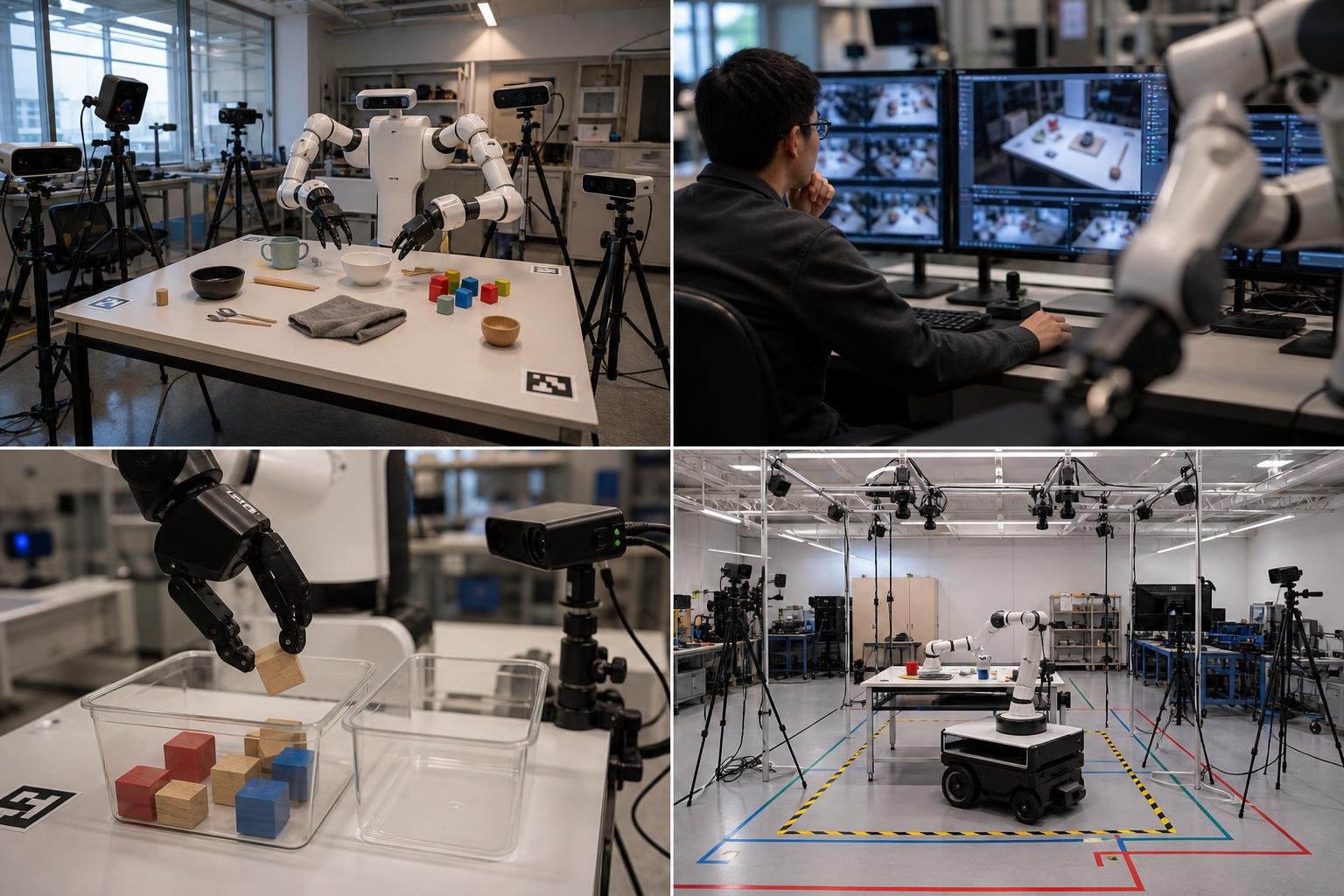

Nel report arXiv, gli autori dichiarano risultati forti: RLDX-1 supera baseline recenti come π₀.₅ e GR00T N1.6 su benchmark simulativi e task reali, e viene riportato un risultato dell'86,8% su task umanoidi ALLEX contro baseline intorno al 40%. Il blog cita anche miglioramenti su inference, dataset sintetici e velocità di esecuzione.

Sono numeri interessanti, ma vanno letti come risultati di laboratorio e benchmark, non come garanzia che domani una mano robotica risolva ogni picking industriale. La storia della robotica è piena di demo corrette in ambiente controllato e difficili da scalare quando arrivano polvere, lubrificante, luce variabile, tolleranze reali e tempi ciclo.

La cosa davvero utile non è il numero isolato. È la direzione progettuale: smettere di trattare la mano come una webcam con dita e iniziare a trattarla come un sistema fisico.

Perché interessa anche a una PMI manifatturiera

A prima vista RLDX-1 sembra lontano da un'officina o da una linea di confezionamento. In realtà anticipa una domanda che arriverà presto anche nei progetti più pratici: quali informazioni deve sentire il robot per non essere fragile?

In assemblaggio, la pressione di inserimento può distinguere un componente allineato da uno che sta danneggiando il pezzo. In asservimento macchine, una presa leggermente diversa può cambiare scarico, carico e orientamento. Nella movimentazione interna, oggetti deformabili, scatole rovinate e mix di colli mettono in crisi la pura visione.

La lezione per oggi è pragmatica: se il tuo processo dipende dal contatto, non progettare solo la traiettoria. Progetta sensori, fixture, log, soglie di forza, recovery e dati di errore. Per i reparti high-mix, questo si collega direttamente al tema dei robot adattivi e del cambio formato: una cella flessibile regge solo se sa misurare anche contatto, scivolamento e recupero degli errori.

La memoria è la parte meno scenica, ma forse la più importante

Un robot che manipola oggetti deve sapere anche dove si trova nel compito. Ha già preso quel pezzo? Ha già tentato quella presa? Il contatto è fallito o sta semplicemente aspettando? Il modulo di memoria di RLDX-1 punta proprio a evitare che la policy perda contesto durante task lunghi.

Questa idea è meno virale di una mano che ruota un dado, ma più industriale. In produzione, gli errori costosi spesso non nascono da un singolo movimento sbagliato: nascono da una sequenza non recuperata. Un robot che sbaglia e non sa di aver sbagliato è pericoloso per qualità, uptime e fiducia degli operatori.

Conclusione

RLDX-1 non chiude la partita della destrezza robotica, ma sposta bene la discussione. Le mani robotiche non diventeranno utili solo perché assomigliano alle nostre. Diventeranno utili quando il modello saprà vedere, sentire, ricordare e correggersi nel mondo fisico.

Per chi compra robot oggi, la domanda non è “quando arriverà la mano universale?”. È più concreta: quali segnali mancano al mio processo perché il robot sia affidabile? Se vuoi ragionare su una cella dove presa, contatto e qualità contano davvero, contattaci: spesso la destrezza inizia da un sensore ben scelto, non da una demo spettacolare.

Fonti consultate

Articoli correlati

Vedi tutti →

Robot che imparano guardando video: promessa o scorciatoia?

Data robotici 2026: la fabbrica che prepara la physical AI

Figure 03: un umanoide ogni ora, ma la notizia è BotQ

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.