La notizia più utile della settimana per chi si occupa di robotica industriale non è un nuovo chatbot montato su un braccio. È molto più concreta: Google DeepMind ha presentato Gemini Robotics-ER 1.6, un aggiornamento pensato per il ragionamento fisico dei robot, con un focus che interessa davvero gli impianti: lettura strumenti, multi-view reasoning e success detection.

Detto in modo meno elegante e più industriale: il modello promette di capire meglio se un robot sta guardando il posto giusto, se un'operazione è finita davvero e se un manometro o un sight glass stanno dicendo qualcosa di importante. Questo è il tipo di salto che nelle ispezioni può spostare il valore dal laboratorio al turno reale.

Cosa è successo

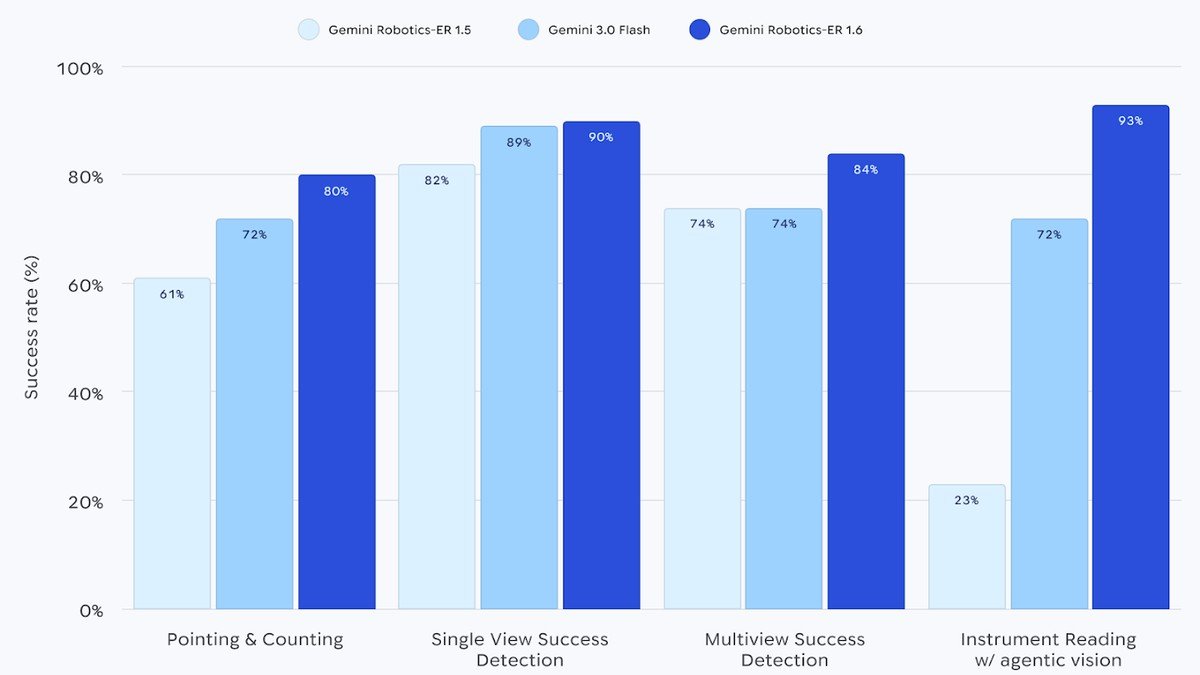

Nel post del 14 aprile 2026, DeepMind presenta Gemini Robotics-ER 1.6 come una versione più forte rispetto a ER 1.5 e a Gemini 3.0 Flash su compiti cruciali per la robotica: pointing, counting, success detection e soprattutto instrument reading. L'azienda spiega che il caso d'uso è emerso anche dal lavoro con Boston Dynamics, in particolare sulle esigenze di ispezione impianto.

La parte più importante non è la retorica sull'"embodied reasoning", ma l'esempio operativo. DeepMind mostra il modello alle prese con manometri, indicatori verticali e display, mentre Boston Dynamics ha già annunciato l'integrazione di Gemini e Gemini Robotics-ER 1.6 in Orbit AIVI-Learning. Sul lato prodotto il messaggio è chiarissimo: Spot e Orbit puntano a fare meglio gauge reading, sight glass fullness, pallet counting, 5S e ispezioni più complesse senza fermare il sistema per aggiornamenti manuali.

Perché questa notizia conta

Per anni l'ispezione robotica ha fatto bene soprattutto ciò che era facile da definire: presenza/assenza, anomalie grossolane, check visivi molto strutturati. Il problema in impianto è che una parte del lavoro utile non è binaria. Bisogna leggere una scala, interpretare un ago, capire se un livello è accettabile, decidere se un task è stato davvero completato guardando più angolazioni.

È qui che ER 1.6 prova a fare il salto. DeepMind parla di multi-view understanding, cioè capacità di combinare più flussi visivi, e di success detection, cioè giudicare se l'azione richiesta è effettivamente riuscita. Sono funzioni meno appariscenti di una demo virale, ma valgono molto di più quando il robot deve lavorare in ambienti dove un falso positivo costa tempo e un falso negativo può costare fermo linea.

Sul piano industriale, Boston Dynamics aggiunge un altro dettaglio importante: AIVI-Learning richiede condivisione dati per migliorare il modello sul contesto del sito. Non è un dettaglio legale messo in fondo alla pagina. È il promemoria che l'AI fisica non vive di slogan: vive di dati di impianto, deployment continuo e integrazione con il flusso operativo.

Cosa cambia per le aziende italiane

Per chi guarda alla robotica in fabbrica o in utility, questa notizia apre tre considerazioni molto concrete.

- Le ispezioni diventano più profonde: non solo "vedo un oggetto", ma leggo e interpreto uno strumento con più affidabilità.

- Conta l'intero stack, non il quadrupede da solo: sensori, modello, pipeline dati, audit e aggiornamenti diventano parte del prodotto.

- Il valore sale in scenari ripetitivi ma complessi: utility, impianti, magazzini, siti con checklist di sicurezza e monitoraggio continuo sono i candidati naturali.

In questa direzione si muovono già applicazioni di ispezione e sorveglianza robotica e robot mobili pronti a lavorare in ambienti impegnativi come Unitree B2, ma la lezione di oggi è più ampia: l'hardware da solo non basta più. Senza un layer di reasoning credibile, il robot raccoglie immagini; con il layer giusto, comincia a generare decisioni utili.

In breve

I take-away per chi legge velocemente:

- Gemini Robotics-ER 1.6 punta a migliorare lettura strumenti, success detection e ragionamento su più viste.

- Boston Dynamics lo sta già portando dentro Orbit AIVI-Learning per ispezioni reali su gauge, sight glass, pallet e 5S.

- Il valore per l'industria non è l'effetto wow dell'AI, ma la qualità delle decisioni che il robot riesce a prendere in sito.

Se questa traiettoria regge anche fuori dai benchmark, il prossimo salto dell'ispezione robotica non sarà il robot che vede di più. Sarà il robot che capisce meglio cosa ha appena visto. E per molte aziende è esattamente la differenza tra un progetto pilota curioso e uno strumento che merita budget. Se vuoi capire come applicarlo al tuo contesto, contattaci per un confronto.

Articoli correlati

Vedi tutti →

KUKA Automation 2.0 2026: cosa cambia davvero in fabbrica

IntBot e Certis: i robot sociali devono superare il test del pubblico

Sensori e visione GMSL: perché il robot industriale vede solo se la rete regge

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.