Cognex ha lanciato In-Sight 3900, un sistema di visione AI integrato pensato per ispezioni industriali ad alta velocità. The Robot Report lo ha ripreso il 9 maggio 2026 con un dettaglio che merita attenzione: la promessa non è solo “AI più intelligente”, ma ispezione più profonda senza sacrificare throughput e semplicità di deploy.

Per chi produce, questo è il punto decisivo. Un modello AI che vede difetti complessi ma rallenta la linea non scala. Un sistema rapido ma fragile genera falsi scarti, rilavorazioni e sfiducia degli operatori. La visione industriale del 2026 deve tenere insieme profondità, tempo ciclo e manutenzione.

In sintesi

La visione AI edge è utile quando porta decisioni di qualità vicino alla macchina, riducendo ritardi tra difetto rilevato, scarto e reazione del robot o del PLC. Il progetto parte dal difetto da intercettare e dal tempo ciclo disponibile, poi sceglie ottica, illuminazione, modello e integrazione.

Cosa è stato annunciato

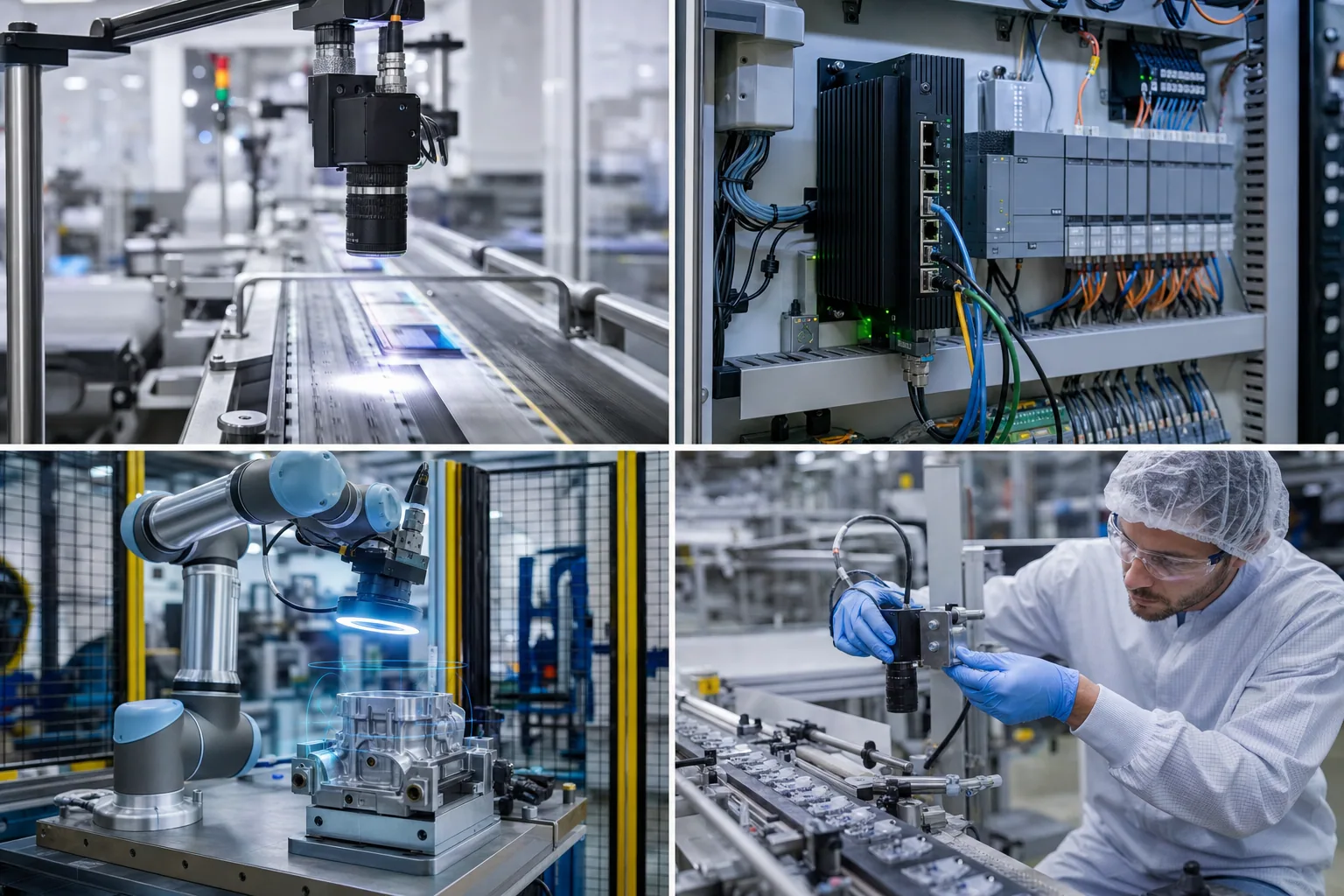

Secondo The Robot Report, In-Sight 3900 combina edge AI sviluppata da Cognex, strumenti AI avanzati e tool rule-based con calcolo embedded ad alte prestazioni. La piattaforma è costruita su tecnologia Qualcomm Dragonwing e punta a esecuzione real-time, connettività industriale dual Ethernet e risoluzioni fino a 25 megapixel.

Il dato più utile per leggere la notizia è il “fino a 4x più veloce” rispetto alla generazione precedente di sistemi Cognex citato nell'articolo. Non va preso come promessa universale per ogni impianto, ma come segnale di mercato: la battaglia si sposta su quanta AI riesci a far girare vicino alla linea senza trasformarla in un server farm o in un progetto IT infinito.

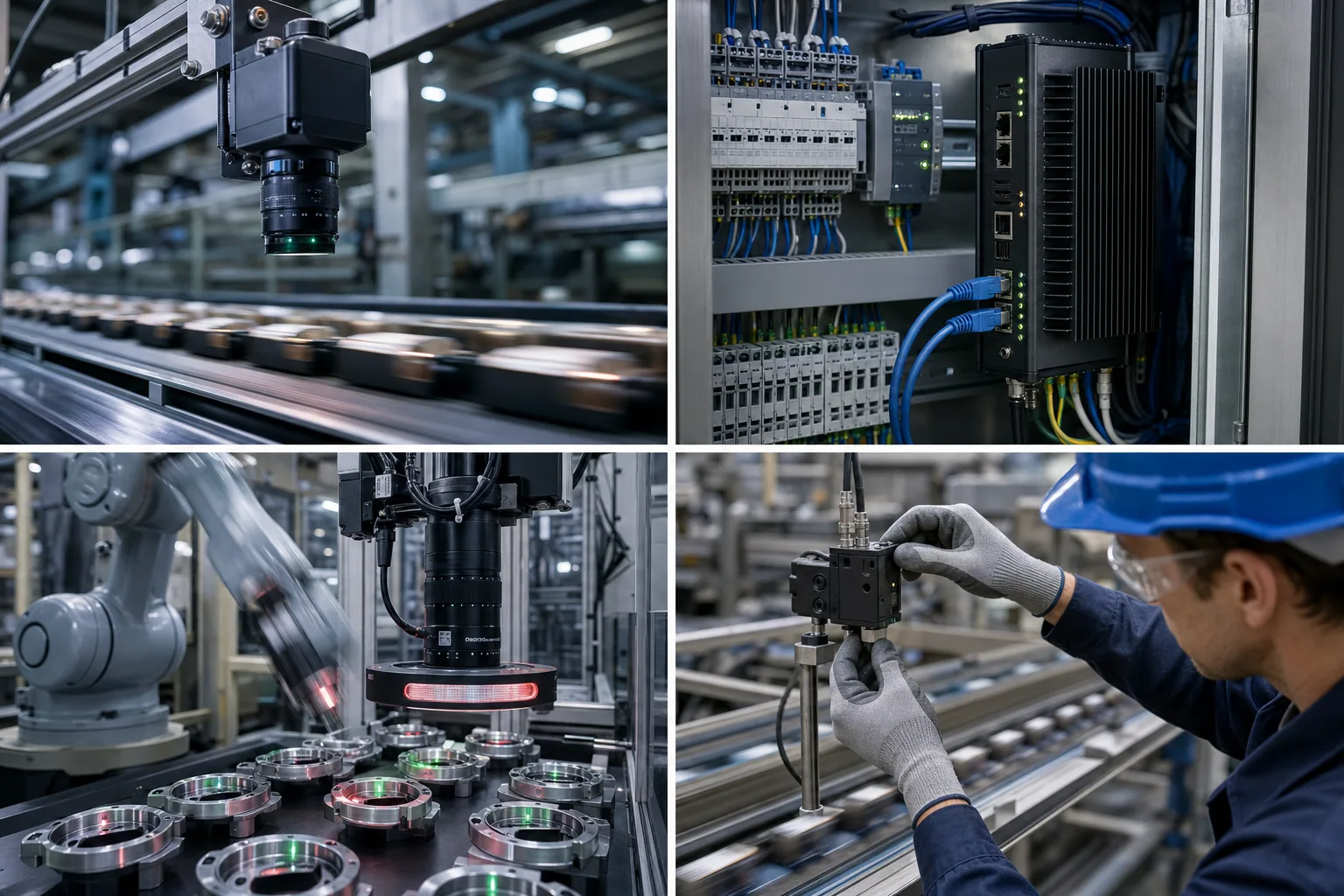

Perché l'edge conta davvero

Dire “edge AI” può sembrare marketing. In produzione, invece, significa tre cose molto concrete.

La prima è latenza: se il robot deve scartare un pezzo, correggere una presa o fermare una stazione, la decisione deve arrivare nel tempo utile della macchina. La seconda è affidabilità: meno dipendenza da rete esterna, cloud o round-trip dati quando il processo non può aspettare. La terza è governance: immagini, ricette, modelli e log restano più vicini al perimetro OT, dove IT e qualità possono validarli con procedure chiare.

Questo non elimina il cloud. Lo ridimensiona. Addestramento, collaborazione tra siti e gestione modelli possono stare su piattaforme centrali; l'esecuzione critica deve stare dove il pezzo passa davvero.

Dove si vede il valore in fabbrica

Le applicazioni più immediate sono packaging, automotive, elettronica e beni di consumo, cioè contesti citati anche nella comunicazione riportata da The Robot Report. Sono linee dove coesistono volumi alti, variabilità e difetti piccoli: etichette, OCR, orientamento, graffi, saldature, componenti mancanti, deformazioni, codici, packaging non conforme.

Per Bubbles, il punto interessante è l'integrazione con robot e processi. In una cella di assemblaggio, la visione può verificare presenza e orientamento prima della presa. In asservimento macchine, può distinguere pezzi, controllare posizionamenti e ridurre errori di carico. In scarico e carico, può decidere se un pezzo va a buffer, scarto o rilavorazione.

La differenza tra una demo e un progetto riuscito sta nella domanda di partenza: non “quale modello AI usiamo?”, ma “quale decisione di qualità deve avvenire entro quale tempo ciclo?”.

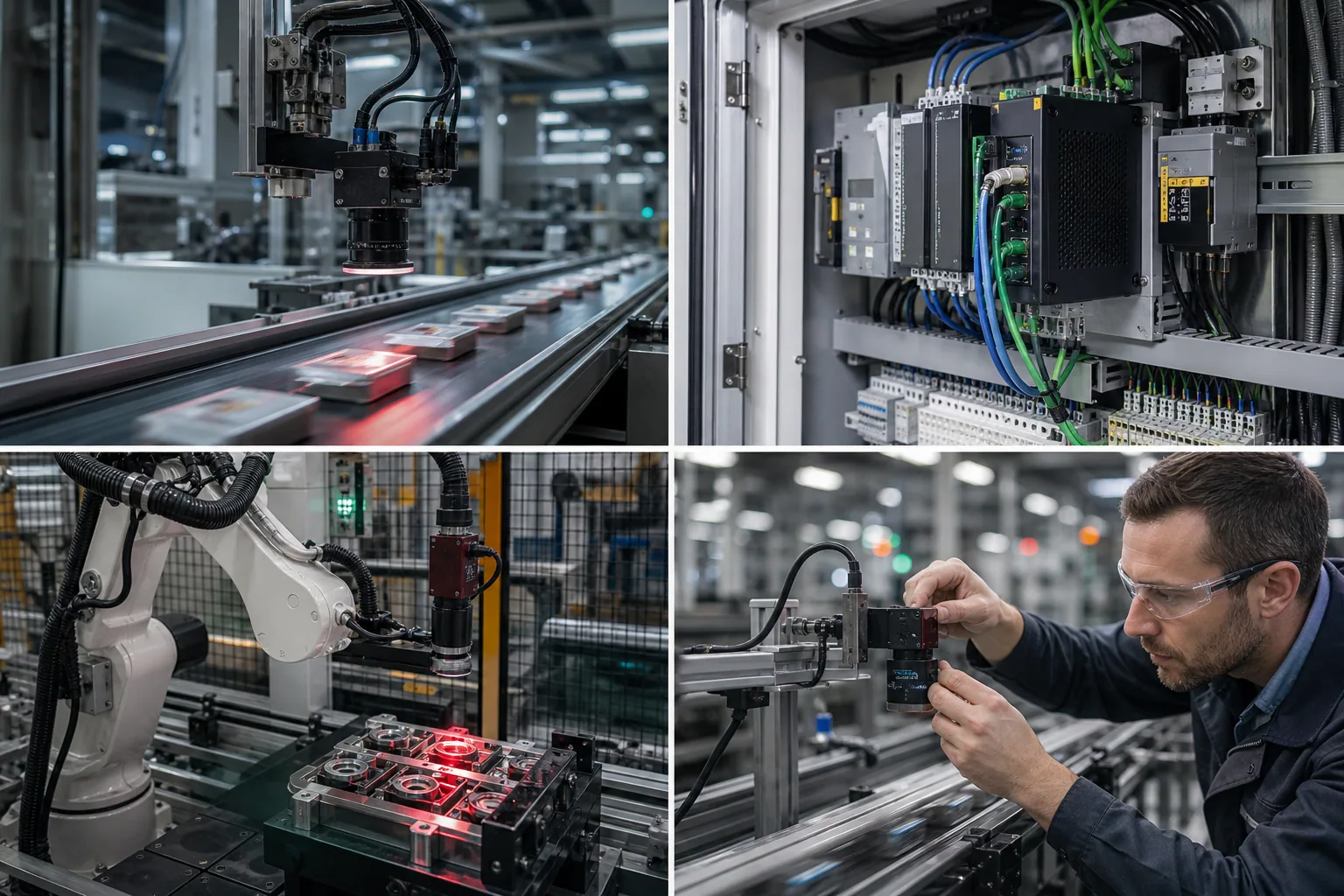

Il rischio: comprare AI e dimenticare l'ottica

La parte più facile da vendere è il modello. La più difficile da far funzionare tutti i giorni è la scena: illuminazione, lente, vibrazioni, polvere, riflessi, distanza, fixture, cambio formato e pulizia. Una visione AI edge può essere potente, ma se la camera guarda male, impara male e decide peggio.

Per questo un progetto serio dovrebbe fissare prima cinque parametri:

- difetti da intercettare e soglia di accettazione;

- tempo massimo disponibile per acquisizione e decisione;

- gestione di falsi positivi e falsi negativi;

- integrazione con PLC, robot, HMI e log qualità;

- procedura di retraining o aggiornamento modello dopo cambio prodotto.

Solo dopo ha senso scegliere hardware, risoluzione, illuminazione e software. L'AI non elimina l'ingegneria di processo: la rende più visibile.

Conclusione

La notizia Cognex è utile perché sposta la discussione dalla promessa astratta dell'AI alla macchina reale: una linea veloce, un difetto da trovare, un robot o un PLC che devono reagire subito. È lì che la visione edge può cambiare davvero il controllo qualità, soprattutto se viene progettata insieme a bracci robotici e cobot e a un'architettura edge industriale governabile.

Per le PMI, il consiglio è pragmatico: partire da un difetto costoso e frequente, misurare tempo ciclo e costo dello scarto, poi progettare la visione come parte della cella. Se vuoi capire dove una camera AI ha senso nel tuo processo, contattaci: il primo passo non è il modello, è il problema giusto.

Fonti consultate

Articoli correlati

Vedi tutti →

Architettura edge robotica 2026: la fabbrica diventa orchestrata

Agenti AI in fabbrica 2026: cosa serve prima dei robot autonomi

Automate 2026 mette AI, robotica e lavoro al centro

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.