Robot e tatto: perché le dita sensorizzate cambiano tutto

I robot oggi vedono meglio di quanto vedessero un anno fa. Riconoscono oggetti, stimano pose, seguono traiettorie e, con i modelli vision-language-action, iniziano persino a scegliere un’azione plausibile. Eppure basta mettergli in mano un bicchiere bagnato, una busta morbida o un componente leggermente disallineato per ritrovare il problema vero: il robot può vedere l’oggetto, ma non lo “sente” davvero.

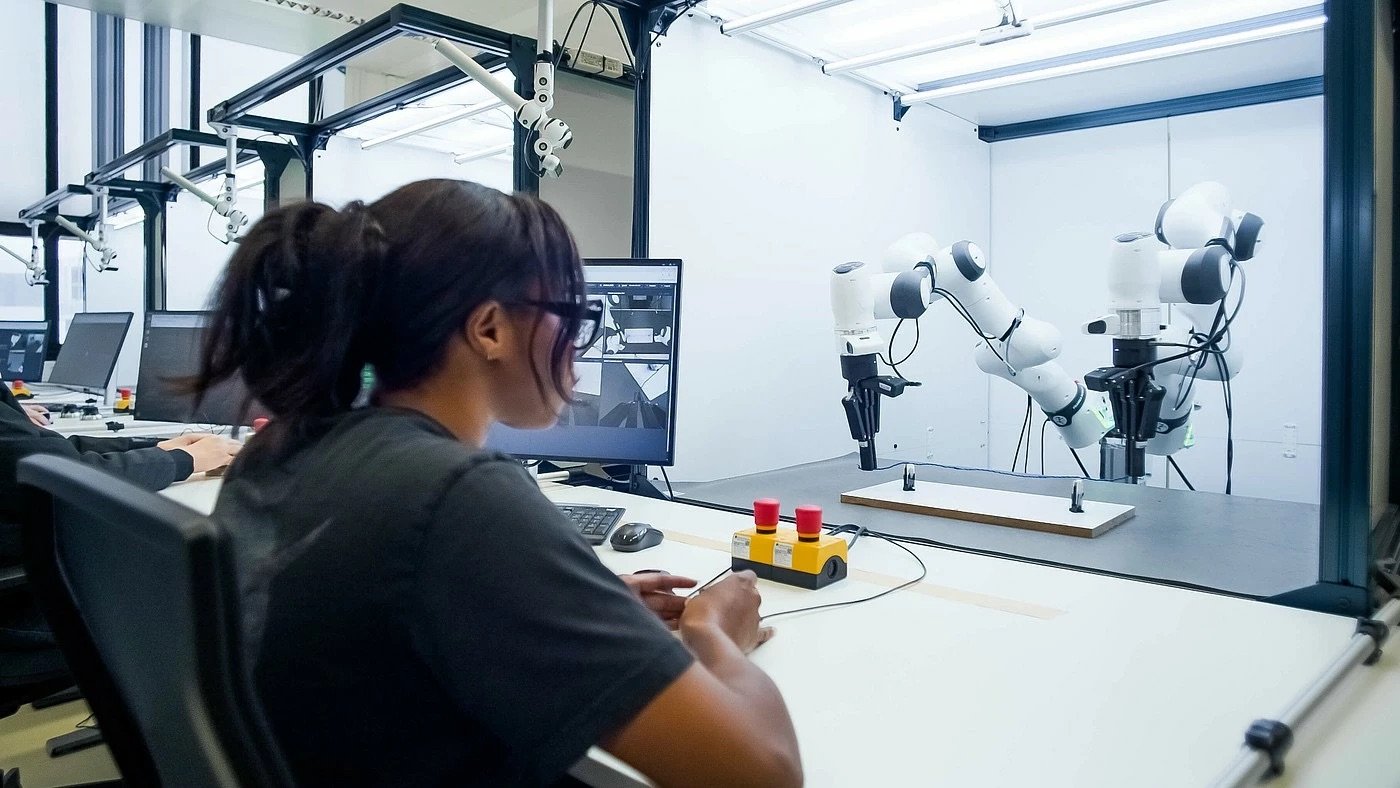

È qui che la novità di Robotiq merita attenzione. Automation World ha raccontato il lancio dei TSF-85 tactile sensor fingertips per il gripper 2F-85: non un gadget da laboratorio, ma un segnale preciso sul punto dove il physical AI rischia ancora di fermarsi — il contatto.

La vista non basta quando inizia la fisica

Robotiq lo spiega in modo molto chiaro nel suo blog: la visione funziona bene per rilevare oggetti, orientamento, ostacoli e scene. Ma quando il robot chiude la presa entrano in gioco variabili che la camera non misura direttamente:

- forza di contatto;

- distribuzione della pressione;

- attrito;

- micro-slip;

- compliance del materiale.

Noi umani correggiamo queste cose senza pensarci. Se un oggetto scivola, stringiamo un po’ di più. Se una superficie è delicata, alleggeriamo. Se una scatola cede, cambiamo appoggio. Il robot, senza feedback tattile, deve inferire tutto da indizi esterni. È una strategia fragile.

Per questo il tema non è “dare più AI al robot” in astratto. Il tema è dare al robot un contatto più leggibile con il mondo reale.

Cosa aggiungono davvero le dita sensorizzate

Secondo la pagina prodotto Robotiq, i TSF-85 portano nel gripper tre strati di informazione molto concreti:

- 28 taxels per leggere la pressione sul punto di contatto;

- sensing dinamico a 1000 Hz per vibrazioni e micro-slip;

- IMU integrata per una forma di propriocezione del sensore nello spazio.

Le funzioni dichiarate sono ancora più interessanti delle specifiche: slip detection, dynamic regrasping, object recognition tattile, valutazione della grasp quality e localizzazione dell’oggetto in presa. In altre parole, il robot smette di essere un sistema che “chiude la pinza e spera” e inizia a ricevere un feedback utilizzabile mentre l’azione è in corso.

Questo spiega perché Robotiq parla di applicazioni immediate in AI training labs, humanoid robotics e physical AI industriale. Non perché il tatto renda magicamente intelligente un robot, ma perché riduce l’ambiguità della manipolazione.

Il punto non è il sensore: è il gripper come interfaccia tra AI e mondo

C’è una frase del blog Robotiq che vale più di molte presentazioni sul physical AI: il gripper è il punto in cui l’intelligenza incontra la fisica. È vero.

Possiamo avere modelli eccellenti su percezione e pianificazione, ma se il gripper non regge variabilità, deformazioni, oggetti scivolosi o cambi di formato, tutta l’intelligenza resta bloccata un centimetro prima del valore.

Per questo il discorso interessa anche chi oggi non sta costruendo umanoidi e non ha un lab di reinforcement learning. Interessa chi fa:

- picking variabile;

- caricamento/scaricamento macchine;

- asservimento materiali;

- assembly leggero;

- bin picking e prese con orientamento incerto.

Se volete portare più adattività in queste aree, il primo passo non è inseguire il modello più rumoroso del mese. È capire se l’end-of-arm tooling è all’altezza del lavoro. Nei progetti di assemblaggio robotizzato e di scarico-carico, questa è spesso la differenza tra demo riuscita e uptime ripetibile.

Perché questa notizia conta più di quanto sembri

La notizia non diventerà virale perché parla di 28 taxels o di un bus RS-485. Ma dovrebbe interessarci proprio per questo: tocca il limite meno glamour e più industriale della nuova robotica.

Oggi tutti parlano di foundation models, agentic AI e robot generalisti. L’IFR, però, ricorda che la sfida del 2026 non è solo aumentare l’autonomia: è farlo in modo affidabile, sicuro e sostenibile in contesti reali. E contesto reale, in manipolazione, significa oggetti che scivolano, cambiano, si deformano e non collaborano con il prompt.

Qui torna utile anche la nostra riflessione su come valutare davvero l’AI generativa in robotica industriale: la parte difficile non è generare un’azione plausibile, ma renderla robusta a livello operativo.

L'hardware gap del physical AI

Un altro punto forte del ragionamento Robotiq è questo: hardware migliore restringe il problema che il software deve risolvere. È una verità quasi anti-hype, ma industrialmente potentissima.

Un gripper adattivo con feedback tattile:

- stabilizza la presa;

- riduce l’incertezza;

- genera dati migliori per l’addestramento;

- rende più chiari i fallimenti;

- riduce il numero di recovery costosi.

In pratica, il sensore non sostituisce il modello: lo rende meno cieco nel momento più costoso del task. È anche per questo che vedremo crescere l’attenzione su sensori, EOAT e meccanica intelligente, non solo sui modelli.

Conclusione

Nel 2026 il messaggio è semplice: i robot non hanno bisogno solo di modelli migliori. Hanno bisogno di mani migliori.

Le nuove dita sensorizzate non risolvono da sole il problema della manipolazione, ma mostrano dove si giocherà la partita vera dei prossimi mesi. Finché il robot non sente, la sua intelligenza resta incompleta. E quando la presa sbaglia, il lettore finale non ricorda il nome del modello AI: ricorda il pezzo caduto.

Se volete capire dove sensori, tooling e processo possono fare davvero la differenza in cella, il passo più utile resta sempre lo stesso: partire dall’applicazione, non dalla moda.

Fonti

- Automation World, Robotiq Unveils Sensor Fingertips for Adaptive Grippers — https://www.automationworld.com/factory/robotics/news/55355049/robotiq-unveils-sensor-fingertips-for-adaptive-grippers

- Robotiq, Tactile Sensor Fingertips — https://robotiq.com/tactile-sensor-fingertips

- Robotiq Blog, Robots can see. But they still can’t feel. — https://blog.robotiq.com/robots-can-see-but-they-still-cant-feel

- Robotiq Blog, Why Physical AI needs better hardware, not just better models — https://blog.robotiq.com/why-physical-ai-needs-better-hardware-not-just-better-models

- Robotiq Blog, Why the gripper is the true interface between AI and the physical world — https://blog.robotiq.com/why-the-gripper-is-the-true-interface-between-ai-and-the-physical-world

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.