Se ti stai chiedendo chi stia insegnando ai robot umanoidi a rifare il letto, sparecchiare o piegare una maglietta, la risposta non è “un laboratorio segreto in California”. Sempre più spesso è una persona normale, a casa sua, con uno smartphone legato alla testa.

MIT Technology Review racconta proprio questo: migliaia di lavoratori in Paesi come Nigeria, India e Argentina stanno registrando faccende domestiche in first person per creare i dataset che servono ai robot a capire il mondo fisico. È una scena che sembra uscita da un episodio di Black Mirror, ma in realtà somiglia molto alla vecchia gig economy: solo che stavolta il prodotto non è una consegna, è un pezzo di movimento umano.

In sintesi: il punto non è l’ennesimo video virale di un umanoide. Il punto è che la corsa ai robot che manipolano oggetti nel mondo reale sta creando un nuovo mercato del lavoro invisibile: persone che filmano mani, braccia, stanze e routine quotidiane per generare dati. Se vuoi capire perché piattaforme come Unitree G1 o le roadmap più ambiziose sugli umanoidi continuano a inseguire la destrezza, devi guardare qui: al costo umano dei dati.

Cosa sta succedendo davvero

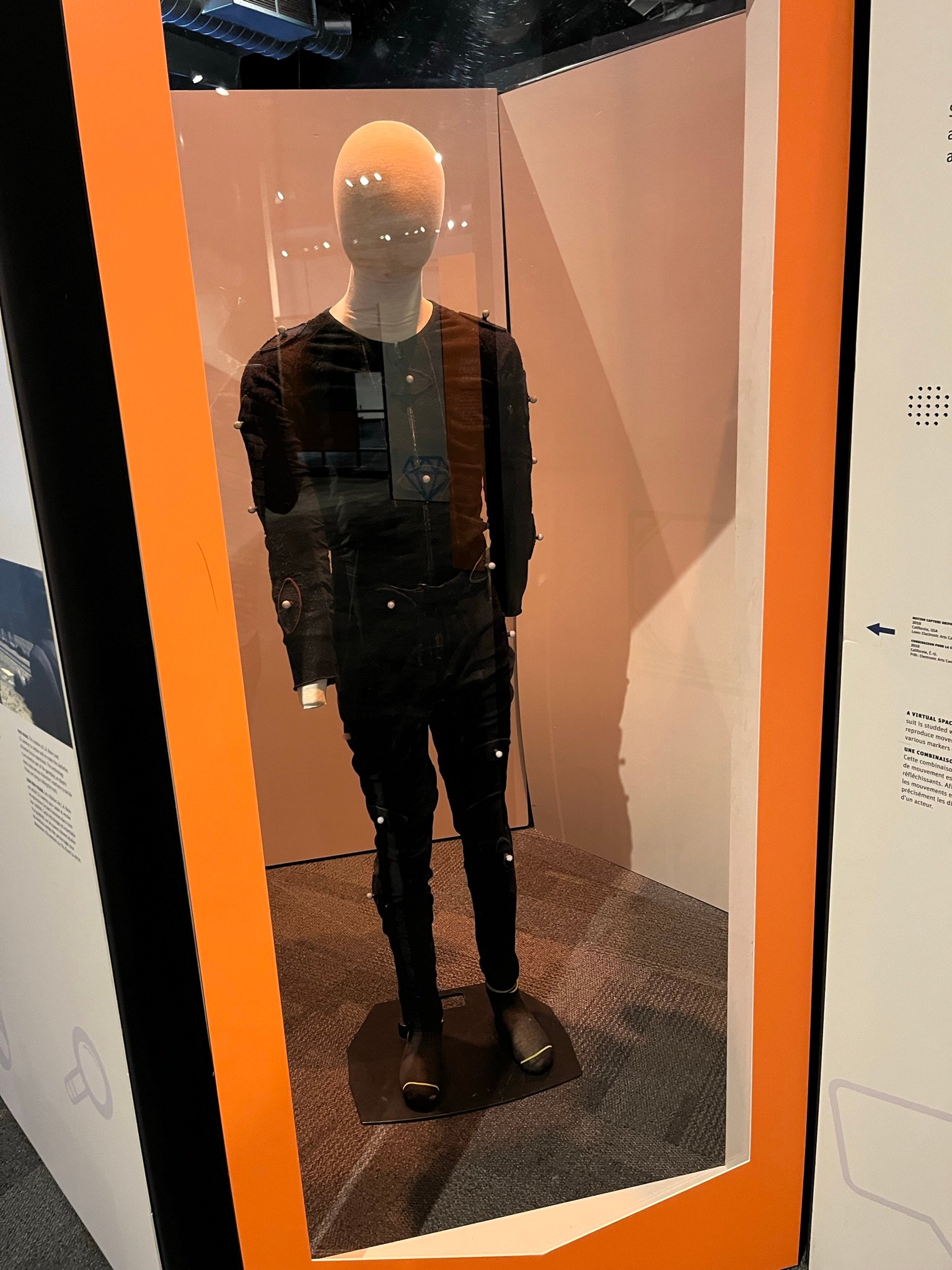

Nel reportage di MIT Technology Review, la startup Micro1 recluta lavoratori che montano un iPhone sulla fronte e si filmano mentre piegano vestiti, lavano piatti, stirano o sistemano il letto. L’idea è semplice e potentissima: se vuoi che un robot capisca come si maneggia un oggetto in ambienti reali, hai bisogno di moltissime variazioni umane dello stesso gesto.

Non basta la simulazione. Non basta un braccio robotico in laboratorio che ripete tre movimenti perfetti. Servono case diverse, tavoli diversi, mani diverse, errori diversi.

La parte sorprendente è che questo lavoro paga abbastanza bene in alcuni contesti locali. MIT Technology Review cita compensi di 15 dollari l’ora per alcuni recorder in Nigeria, una cifra interessante per chi cerca reddito rapido. Però il pezzo fa emergere anche l’altra faccia: monotonia, incertezza su come i dati verranno usati, pressione a inventare sempre nuove “scene domestiche” da filmare.

Perché i robot hanno così fame di dati

I robot umanoidi hanno un problema che i chatbot non hanno mai avuto in quella forma: il linguaggio si può raccogliere a scala internet, ma il mondo fisico no.

Una mano che afferra un piatto bagnato, una coperta che si piega male, una maglietta che scivola, una padella che riflette la luce: queste sono tutte variazioni che un robot deve imparare. E qui la simulazione, da sola, inciampa.

MIT Technology Review lo riassume bene: per far funzionare i robot in fabbrica e nelle case, i dati reali possono essere più utili di quelli sintetici, anche se costano di più e richiedono più tempo. Non a caso Crunchbase ricorda che nel 2025 le startup robotics hanno raccolto oltre 6 miliardi di dollari: una parte crescente di quel capitale sta andando proprio in modelli, dataset e infrastructure layer per la physical AI.

- 🤖 Micro1 parla di migliaia di lavoratori in oltre 50 Paesi: segno che il lavoro non è più sperimentale.

- 📈 Oltre 6 miliardi di dollari raccolti da startup robotics nel 2025: il denaro cerca soprattutto dati e capacità di generalizzazione.

- 📹 DoorDash Tasks entra nello stesso gioco: NBC News racconta task pagati per registrare faccende o contenuti vocali.

- 🏠 La casa diventa un micro-laboratorio: ma senza i controlli, la standardizzazione e la trasparenza di un vero lab.

La metafora più onesta è questa: stiamo costruendo i “driver del mondo fisico” dei robot, ma invece di raccoglierli da sensori industriali standardizzati li stiamo estraendo da cucine, camere da letto e salotti.

Il punto delicato: privacy, qualità, consenso

Qui arriva la parte meno comoda. Chi registra questi video mostra comunque pezzi intimi della propria vita: oggetti, stanze, abitudini, altre persone che passano sullo sfondo. MIT Technology Review sottolinea che molti worker non sanno con precisione come i loro dati verranno conservati, condivisi o rivenduti a terzi.

E poi c’è il nodo qualità. Aaron Prather di ASTM, citato nel pezzo, osserva che i comportamenti domestici non sono automaticamente “buoni dati” da trasferire a un robot in modo sicuro. Se un essere umano fa una cosa in modo inefficiente o rischioso, il robot deve impararla o evitarla? È una domanda meno banale di quanto sembri.

Per questo la storia interessa anche chi guarda la robotica industriale da lontano. Ci ricorda che la vera difficoltà non è far muovere un umanoide in un video, ma costruire pipeline dati affidabili, etiche e abbastanza larghe da generalizzare. Lo avevamo già visto nel passaggio dal lab alla fabbrica in progetti come AI Trainer di Universal Robots; qui la differenza è che il “campo dati” si sposta dentro casa.

E quindi, cosa cambia per noi?

Cambia il modo in cui dobbiamo leggere le demo robotiche. Quando vedi un robot piegare una maglietta con eleganza, la domanda non dovrebbe essere solo “che modello è?”, ma anche: quanti esseri umani sono stati necessari per arrivare a quel gesto?

Per chi segue il mercato, questo significa tre cose molto concrete:

- i dati first-person diventano un asset competitivo, non un dettaglio tecnico;

- la differenza tra showreel e prodotto dipenderà sempre di più dalla qualità del data pipeline;

- gli umanoidi non scaleranno solo con l’hardware, ma con la capacità di raccogliere e pulire lavoro umano distribuito.

È una notizia affascinante e un po’ storta, come spesso accade quando una tecnologia esce dal palco e incontra il lavoro reale. La prossima volta che sentirai dire che “i robot imparano da soli”, prendilo come prenderesti un mobile già montato: probabilmente qualcuno, da qualche parte, ha fatto tutto il lavoro faticoso prima.

Conclusione

La corsa ai robot umanoidi non passa solo da attuatori, batterie e modelli multimodali. Passa anche da migliaia di persone che registrano il proprio quotidiano per trasformarlo in dataset.

È un dettaglio? Per niente. È forse la parte più onesta di tutta la storia, perché ci ricorda che l’automazione, prima di sembrare autonoma, assorbe moltissimo lavoro umano invisibile. Se vuoi capire quali piattaforme robotiche hanno oggi senso commerciale e quali invece vivono ancora di promessa, scrivici: meglio discutere il backstage adesso che comprare il trailer e scoprire il film dopo.

Fonti

- MIT Technology Review, The gig workers who are training humanoid robots at home: https://www.technologyreview.com/2026/04/01/1134863/humanoid-data-training-gig-economy-2026-breakthrough-technology/

- NBC News, DoorDash is now letting its drivers train AI on the side: https://www.nbcnews.com/tech/tech-news/doordash-now-letting-drivers-train-ai-rcna264387

- Crunchbase News, Robotics Startup Funding Rises: https://news.crunchbase.com/robotics/startup-funding-rises-h1-2025-ai-apptronik-data/

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.