Nel 2026 non basta dire “usiamo AI nella robotica”. La domanda vera è: questa AI è governabile in produzione?

La pressione normativa e operativa sta crescendo insieme:

- il quadro UE dell’AI Act è già in applicazione progressiva (proibizioni da febbraio 2025; piena applicazione dal 2 agosto 2026, con alcune estensioni al 2027);

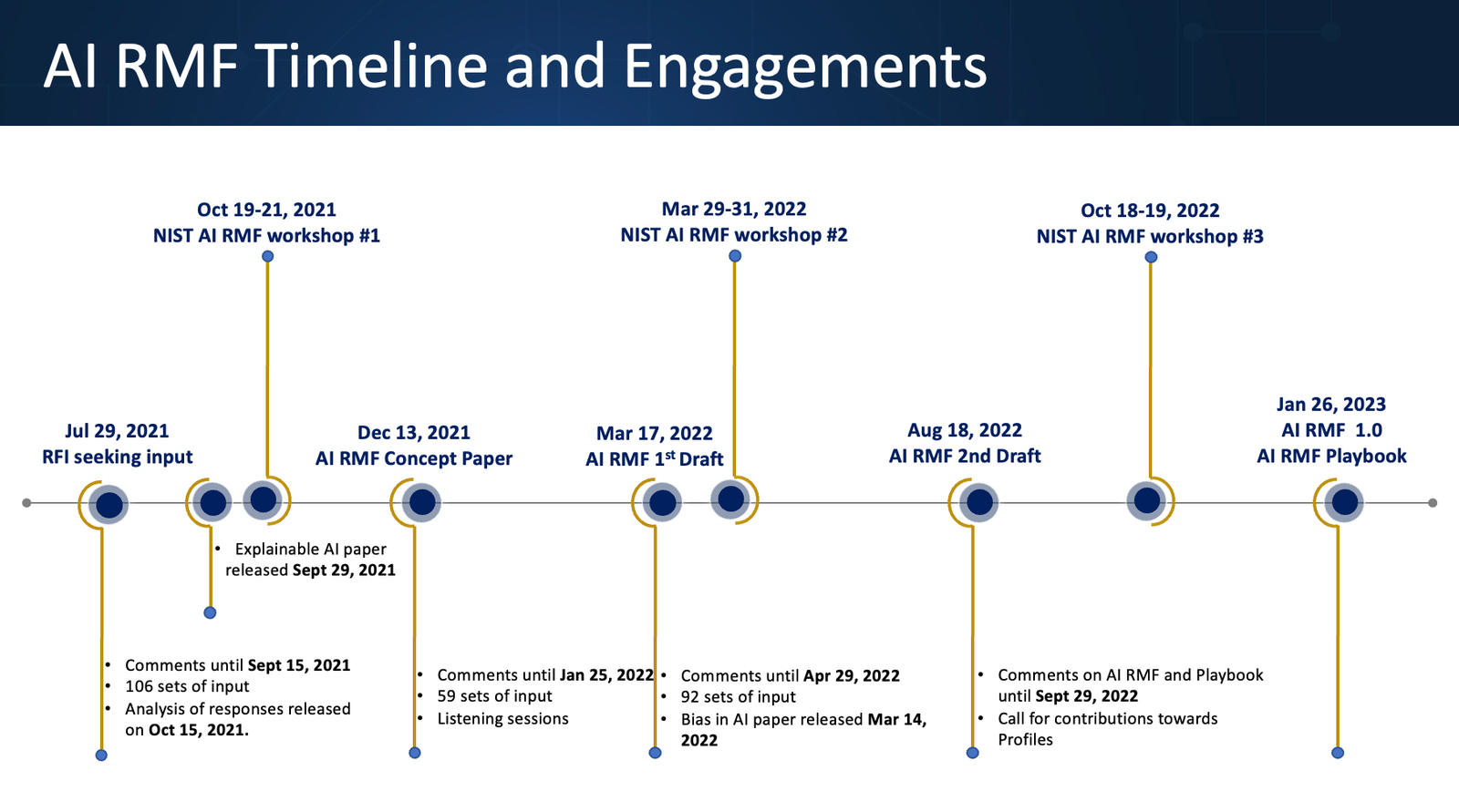

- NIST, con l’AI Risk Management Framework, insiste su un approccio continuo alla gestione del rischio AI;

- la letteratura tecnica (IEEE) evidenzia che tecniche di explainability aiutano a individuare errori decisionali nei sistemi autonomi.

Per i team robotica, questo significa spostarsi da “demo che funziona” a “sistema che regge audit, incidenti e cambi di contesto”.

Cosa chiede davvero il mercato (prima ancora del regolatore)

Sul piano business, i progetti AI in robotica vengono ormai valutati su tre dimensioni insieme:

- prestazione (tempo ciclo, qualità, autonomia);

- affidabilità (stabilità su turni/scenari diversi);

- governance (tracciabilità, responsabilità, capacità di spiegare e correggere).

L’AI Act formalizza questa traiettoria con un impianto risk-based. Ma il punto pratico è più semplice: se non riesci a spiegare come il modello prende decisioni critiche, avrai problemi in esercizio anche senza ispezione formale.

Per questo, nei percorsi di Consulenza Robotica, conviene impostare la governance AI fin dall’MVP industriale, non dopo.

Checklist operativa in 6 blocchi

1) Classifica i casi d’uso AI per impatto reale

Per ogni funzione AI su robot/cella:

- cosa può andare storto;

- quale impatto su safety, qualità, continuità;

- quali condizioni degradano il modello (dati sporchi, drift, sensori degradati).

Senza questa classificazione, non puoi definire priorità né controlli adeguati.

2) Tracciabilità dei dati e delle versioni modello

Minimo indispensabile:

- provenienza dataset;

- criteri di pulizia/labeling;

- versione del modello in produzione;

- changelog inferenze e rollback plan.

È il prerequisito per analizzare incidenti senza “caccia al colpevole”.

3) Explainability “utile”, non accademica

L’articolo IEEE su XAI in sistemi autonomi mostra un punto concreto: spiegazioni e analisi delle feature (es. SHAP) possono aiutare a capire dove il modello sbaglia e perché.

In fabbrica questo si traduce in dashboard e log leggibili da team misti (automazione, qualità, OT), non solo da data scientist.

4) Human oversight e soglie di intervento

Definisci prima del go-live:

- quando l’operatore può/ deve intervenire;

- quando il sistema passa in modalità degradata;

- quando si blocca in sicurezza.

Le policy senza soglie operative diventano solo testo di compliance.

5) Test pre-rilascio su scenari “brutti”

Oltre ai test nominali, inserisci:

- dataset avversi e edge-case;

- sensori degradati o intermittenti;

- variazioni ambientali realistiche (luce, riflessi, occlusioni, latenza).

L’obiettivo non è eliminare l’errore (impossibile), ma conoscere limiti e recovery.

6) Ciclo post-market: monitoraggio, incidenti, miglioramenti

Dopo il rilascio:

- monitor continuo con alert su drift/anomalie;

- processo formale per incident report;

- riesame periodico rischio/controlli.

Questo allineamento riduce attrito con audit clienti e supporta rollout multi-sito.

Se stai già lavorando su use case AI, puoi integrare questa checklist con la roadmap vista in AI nella robotica industriale: use case e KPI e con i criteri operativi di multitasking robot: signal vs demo.

Nota importante su hype e realtà

Nel dibattito pubblico compaiono spesso tesi forti (ad esempio sull’impatto dell’AI Act sui modelli end-to-end). Sono segnali utili, ma vanno trattati come opinioni tecniche, non come fatti normativi.

I riferimenti da cui partire restano i testi ufficiali UE e i framework istituzionali, poi si usano fonti indipendenti per capire implicazioni pratiche.

Conclusione

L’AI Act non è un problema “legale” separato dall’ingegneria: è una spinta a costruire sistemi robotici AI più disciplinati.

Chi imposta ora processi di governance modello-dato-rilascio avrà meno rework, meno attrito in audit e rollout più prevedibili.

CTA — Vuoi una baseline governance AI per i tuoi progetti robotici?

Possiamo aiutarti a creare assessment tecnico, matrice rischio-controlli e piano di adozione per sito/linea.

Valuta anche le piattaforme in shop prodotti o scrivici da contatti.

Fonti

- [Primaria ufficiale] European Commission, AI Act – regulatory framework and application timeline: https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai

- [Fonte tecnica indipendente] IEEE Spectrum, AI Insights Improve Autonomous Vehicles' Decisions (XAI e analisi errori decisionali): https://spectrum.ieee.org/autonomous-vehicles-explainable-ai-decisions

- [Istituzionale/standard] NIST, AI Risk Management Framework (AI RMF 1.0): https://www.nist.gov/itl/ai-risk-management-framework

- [Cross-check] Regulation (EU) 2024/1689 (Artificial Intelligence Act), EUR-Lex: https://eur-lex.europa.eu/eli/reg/2024/1689/oj

- [Cross-check] The Robot Report, Why AIC is the only path to certifiable robotics (contributo di opinione): https://www.therobotreport.com/why-aic-is-the-only-path-to-certifiable-robotics/

Serve supporto per applicare queste idee?

Il team Bubbles Technology progetta soluzioni robotiche su misura per PMI in Campania e in tutta Italia. Prenota una consulenza gratuita per discutere esigenze, ROI e roadmap.